OpenAI: capital, employés, chiffre d'affaires, utilisateurs, projets, mission, procès

Tout ce que vous devez savoir sur OpenAI: historique, capital, fondateur, chiffres-clés, statistiques, technologies, levée de fonds.

Voici le plan de ce dossier sur OpenAI.

Levées de fonds, investisseurs & valorisation

Utilisateurs et indicateur d'activité

Introduction : les chiffres essentiels d’OpenAI

Date de création & fondateurs

OpenAI a été fondée le 8 décembre 2015 par un collectif de personnalités influentes

Sam Altman, Elon Musk, Ilya Sutskever et Greg Brockman, avec l’objectif initial de collecter 1 milliard USD en capital‑risque, dont environ 130 M$ ont été réellement investis avant 2019

Evolution juridique

Initialement conçue comme une organisation à but non lucratif, OpenAI est devenue en mars 2019 une « capped-profit company » afin de lever des fonds privés (notamment de Microsoft) tout en limitant la rentabilité, combinant éthique et rentabilité technologique .

Effectifs

La société compte aujourd’hui environ 500 collaborateurs début 2025, un bond significatif depuis les quelques dizaines d’employés en 2015 (25 selon certaines estimations), preuve de sa rapide montée en puissance opérationnelle

Utilisateurs (ChatGPT)

Novembre 2022

1 million d’utilisateurs en seulement 5 jours

Décembre 2024

300 M utilisateurs actifs hebdomadaires

Février 2025

400 M utilisateurs hebdos .

Mars‑avril 2025

montée à 800 M, doublant en quelques semaines selon Sam Altman au TED 2025

Les projections visent 1 milliard d’utilisateurs fin 2025 .

Fréquentation & engagement

En mars 2025, le site ChatGPT a enregistré 4,5 milliards de visites mensuelles, avec en moyenne 122 M d’utilisateurs actifs quotidiens traitant plus d’un milliard de requêtes par jour

Chiffre d’affaires

2020: 3,5 M$,

2021: 28 M$,

2022: 200 M$

2023: 1,6–2,2 Md$

2024: 3,7 Md$

2025: 12,7 Md$ (croissance ×3,4), ou 10 Md$ de revenus annuels récurrents mi‑2025 (ARR) .

Marges & pertes

Marge brute estimée autour de 40 %, avec objectif d’atteindre 70 % d’ici 2029 .

Déficit net d’environ 5 Md$ en 2024, pertes estimées à 9 Md$ en 2025 et cumulées de 44 Md$ entre 2023–2028 .

Valorisation & levées de fonds

Octobre 2024: levée de 6,6 Md$, valorisation à 157 Md$ .

Mars 2025: record absolu de 40 Md$ levés (dont 10 Md$ versés d’ici mars, 30 Md$ complémentaires attendus) pour une valorisation à 300 Md$ .

Financements totaux cumulés estimés à ~64 Md$, investisseurs clés: SoftBank, Microsoft, Nvidia, Thrive, Coatue, Altimete

Projets technologiques et infrastructure

Janvier 2025: lancement du joint‑venture Stargate LLC (OpenAI : 40 %, SoftBank : 40 %, Oracle, MGX), engagement de 500 Md$ d’infrastructure AI d’ici 2029, construction initiale de 10 datacenters américains, création de plus de 100 000 emplois

Mai 2025: acquisition de la startup hardware io, fondée par Jony Ive, pour environ 6,5 Md$, marquant une diversification vers les composants hardware

Levées de fonds & valorisation

Voici une analyse chiffrée et détaillée des principaux tours de financement d’OpenAI, ainsi que de sa valorisation croissante

Historique des levées de fonds

| Date | Montant levé (en dollars) | Valorisation post-money | Investisseurs clés |

|---|---|---|---|

| Décembre 2015 | Ciblé 1 Md$, 130 M$ investis | - | Musk, Altman, Hoffman, AWS… |

| Juillet 2019 | 1 Md$ (Microsoft) | - | Microsoft |

| Janvier 2023 | 10 Md$ (Azure) | ~29 Md$ | Microsoft |

| Octobre 2024 | 6,6 Md$ | 157 Md$ | Microsoft, Nvidia, Thrive Capital… |

| Mars 2025 | 40 Md$ | 300 Md$ | SoftBank (lead), Microsoft, Coatue, Altimeter, Thrive |

Depuis décembre 2015, OpenAI a levé au total ~57,9 Md$ via 11 tours de financement .

Le plus grand round à ce jour est celui de mars 2025 avec 40 Md$ levés pour une valorisation de 300 Md$, avec 10 Md$ déjà débloqués et 30 Md$ conditionnés à la conversion en entité à but lucratif d'ici fin 2025

Le second record est la levée de 6,6 Md$ en octobre 2024, valorisant l’entreprise à 157 Md$

Valorisation et contexte stratégique

Avec ses 300 Md$ de valorisation en mars 2025, OpenAI se classe parmi les entreprises privées les mieux valorisées au monde, proche de SpaceX (~350 Md$) et TikTok (ByteDance)

À l’automne 2024, la valorisation à 157 Md$ équivalait à un multiple de ~13,5 x le chiffre d’affaires futur, comparable à celui de Facebook au moment de son introduction en Bourse

Le tour de mars 2025 a été structuré avec des accords progressifs : 10 Md$ en avril, 30 Md$ en décembre, conditionnés à la transformation en PBC (public benefit corporation) d’ici fin 2025

Investisseurs et conditions de financement

SoftBank assume le rôle de lead investor avec une contribution majeure de l’ordre de 30 Md$, appuyé par un versement initial de 10 Md$ en avril 2025 .

Microsoft détient actuellement 49 % des profits générés par OpenAI Global, LLC, à hauteur de 13 Md$ investis depuis 2019, avec un retour plafonné (10× l’investissement)

Parmi les autres investisseurs: Coatue, Altimeter, Thrive, Nvidia – présents dès 2024

Enjeux structurels & comparatif marché

OpenAI demeure non cotée en bourse, s’inscrivant dans la tendance de nombreuses entreprises technologiques valorisées privé à rester hors marché boursier pour éviter les contraintes réglementaires et la pression des résultats trimestriels .

Le financement massif de mars 2025 intervient dans un contexte où 64 % des montants investis en start-up US (H1 2025) concernent des projets en IA, avec un total record de 162,8 Md$ injectés

Cette accumulation de capital résonne comme celle de la bulle Internet des années 2000, selon certains observateurs, notamment pour les valorisations records des sociétés liées à l’IA

Investisseurs & montants investis

Série F – Mars 2025 (40 Md$)

SoftBank Group : en tant que lead investor, investit jusqu’à 30 milliards $ (10 Md$ débloqués en avril, 20 Md$ prévus d’ici fin 2025 ; si OpenAI ne passe pas au modèle for-profit, cet apport peut être réduit à 20 Md$)

Microsoft : co-investisseur, représentant environ 25 % du reste soit ~2,5 Md$ (25 % de la tranche initiale hors SoftBank)

Coatue Management, Altimeter Capital, Thrive Capital : participants estimés sur la tranche initiale de 10 Md$, soit ~2,5 Md$ répartis entre eux

Série E – Octobre 2024 (6,6 Md$)

- Microsoft

- Nvidia

- SoftBank Group

- Thrive Capital

- Altimeter Capital

- Khosla Ventures

- Fidelity Investments

- MGX (Abu Dhabi)

Montant total: 6,6 milliards de dollars, valorisation à 157 Md$

Série E – Janvier 2023 (10 Md$)

Microsoft, apport unique de 10 milliards $, valorisant l’entreprise à environ 27 milliards $ .

Série E – Avril 2023 (300 M$)

- Flat Capital

- Tiger Global Management

- Sequoia Capital

- Andreessen Horowitz

- Thrive Capital

- K2 Global

- Founders Fund

Montant total :300 millions $

Série D – Juillet 2019 (1 Md$)

- Microsoft (lead)

- Matthew Brown Companies (co-investisseur)

- Tracxn

- Seed & Grants (2015–2016)

- Y Combinator (Seed 2016)

- Elon Musk, Peter Thiel, Reid Hoffman, Jessica Livingston, Infosys, Amazon Web Services (AWS), YC Research

- Montant global dans la phase non-profit : 130,5 millions $

Dette – Octobre 2024 (4 Md$)

- Wells Fargo

- UBS

- Sumitomo Mitsui Banking Corporation

- Santander

- Morgan Stanley

- JPMorgan Chase

- HSBC

- Goldman Sachs

- Citi

Montant total: 4 milliards $ en financement par emprunt

Liste des principaux invesstisseurs d'OpenAI

| Investisseur | Montant investi | Round principal |

|---|---|---|

| SoftBank Group | 30 Md$ | Série F |

| Microsoft | 10 Md$ + part de la série F | Série E 2023 + F 2025 |

| Nvidia | une partie de 6,6 Md$ | Série E 2024 |

| Thrive Capital | part dans 300 M$ + 6,6 Md$ + 40 Md$ | 2023, 2024, 2025 |

| Altimeter Capital | une partie de 6,6 Md$ + 40 Md$ | 2024 & 2025 |

| Coatue Management | une partie de 40 Md$ | 2025 |

| Khosla Ventures | une partie de 6,6 Md$ | 2024 |

| Fidelity Investments | une partie de 6,6 Md$ | 2024 |

| MGX (Abu Dhabi) | une partie de 6,6 Md$ | 2024 |

| Flat Capital | 300 M$ | 2023 |

| Tiger Global | 300 M$ | 2023 |

| Sequoia Capital | 300 M$ | 2023 |

| Andreessen Horowitz | 300 M$ | 2023 |

| K2 Global | 300 M$ | 2023 |

| Founders Fund | 300 M$ | 2023 |

| Matthew Brown Cos. | non précisé | 2019 |

| Y Combinator | seed 2016, petit montant | 2016 |

| Musk, Thiel, Hoffman, AWS, Infosys, YC Research | 130,5 M$ (non‑profit) | 2015–2016 |

| Consortium bancaire | 4 Md$ (Dette) | Dette Octobre 2024 |

Conditions du tour de financement de mars 2025

- Structure en deux étapes (total 40 Md$)

- 10 Md$ débloqués en avril 2025, versés directement à OpenAI Global, sans conditions attachées

- 30 Md$ supplémentaires prévus en décembre 2025, conditionnés à la transformation de la structure juridique (passage d’un “capped-profit LLC” à une public benefit corporation) d’ici fin 2025

- Si la transition n’a pas lieu, SoftBank réduira son versement de 30 Md$ à 20 Md$, ou potentiellement moins, et certains co-investisseurs pourraient s’en retirer .

Sanctions financières en cas de non-transformation juridique

- SoftBank détient la possibilité de réduire de 10 Md$ son investissement si OpenAI ne convertit pas sa structure en société à but lucratif avant le 31 décembre 2025

- De même, des investisseurs du tour E de 6,6 Md$ (oct. 2024) pourraient voir leurs apports requalifiés en dette à taux d’intérêt si la conversion échoue d’ici octobre 2026 .

Restructuration avec Microsoft

Microsoft perçoit 20 % du chiffre d’affaires d’OpenAI, plafonné à environ 92 Md$

Droits exclusifs

Microsoft détient l'exclusivité de revente des modèles OpenAI via Azure jusqu’en 2030, avec droit de refus prioritaire sur l’accès à l’infrastructure et propriété intellectuelle en cas d’AGI

Clause AGI

Si OpenAI atteint un niveau d’AGI (c'est à dire, pas l'AGI au sens où les experts de l'IA l'entendent, mais si le cap des 100 Md$ de bénéfices est franchi), Microsoft pourrait perdre certains droits sur la technologie AGI. Cette clause est actuellement en renégociation

Renégociation en cours (mai 2025)

Microsoft veut être certain que, même après IPO, il conservera l’accès aux prochains modèles (post‑2030) en échange d’une participation minoritaire dans la nouvelle structure

Gouvernance & contrôle

La structure Non‑profit parent garde la majorité des pouvoirs de gouvernance, même dans la structure PBC (société)

La transformation vers une PBC est sujette à approbation de la justice de Californie et du Delaware.

En cas de non-respect des engagements, OpenAI risque retraits de fonds, transformation en dette et remise en cause des droits de Microsoft.

La transformation de l'association à but non lucratif en société

En mai 2025, OpenAI a confirmé la conversion de sa filiale à but lucratif (LLC) en Delaware Public Benefit Corporation (PBC), tout en précisant que la branche non-profit conservera le pouvoir de gouvernance sur cette nouvelle entité

L’intention est de lever des capitaux plus facilement, en renonçant à la structure "capped-profit" au profit d’une structure plus standard, compatible avec les attentes des investisseurs

Pressions et ajustements face aux autorités et critiques

Le projet initial de transformer la non-profit en entité indépendante a été abandonné après retour de bâton d’Elon Musk, d’anciens salariés, et d’investigations ouvertes par les attorneys general de la Californie et du Delaware

OpenAI a ainsi réaffirmé que

- Le contrôle opérationnel reste entre les mains de la branche association.

- L'association sera aussi actionnaire important de la société

Enquêtes menées par les autorités de régulation

Les états de Californie et du Delaware mènent actuellement des enquêtes formelles pour s’assurer que

- Les actifs de l'association restent protégés.

- Les accords financiers entre l'association et la société respectent le droit des associations

Une plainte auprès de l’IRS américain accuse OpenAI de favoriser les intérêts personnels de Sam Altman et de son conseil au détriment de l’objet social de l'association.

Opposition de la société civile et d’anciens salariés à la transformation d'association en société

Des groupes comme Coalition for AI Nonprofit Integrity (CANI) et Public Citizen affirment que la transformation pourrait :

- Diminuer le pouvoir effectif de la non-profit.

- Permettre un dérèglement des intérêts publics au bénéfice des investisseurs

Prochaines étapes

- Fin 2025: validation ou invalidation juridique finale de la structure de la société (et de la gouvernance associée) par les états du Delaware et de Californie.

- Suivi des transferts d’actifs depuis l'association vers la société, audits externes et transparence sur leur affectation.

- Résolution du recours juridique d’Elon Musk et des ONG réclamant plus de garanties sur la mission publique.

Gouvernance d'OpenAI

La gouvernance d'OpenAI est un peu compliquée du fait de l'enchevêtrement de structure et des statuts particuliers de ces structures:

- OpenAI, Inc., l'association, enregistré dans le Delaware demeure l’organe de contrôle principal qui détient une majorité des droits de vote sur la filiale opérationnelle, assurant que la mission caritative prime toujours sur la recherche de profit.

- OpenAI Global, LLC, créée en 2019 sous un statut américain de « capped-profit » pour attirer des investisseurs tout en limitant les plus values (9 000% de plus value maximum pour les premiers investisseurs). Elle est totalement contrôlée par l'association via des droits de gouvernance et des membres du conseil interdit de vote en cas de conflit d’intérêts

- Transition en cours vers PBC (Public Benefit Corporation)

- L’entité à but lucratif devient une société PBC du Delaware (entrepris à mission ?) s'engageant à poursuivre un bénéfice pour la communauté.

- L’association à but non lucratif conserve le contrôle de la PBC et devient un actionnaire majeur, symbolisant son influence continue

Les organes et régles de décision

- Conseil d’administration du non-profit

Composé notamment de Bret Taylor (président), Sam Altman, Lawrence Summers, Adam D'Angelo, etc.

Ce conseil supervise directement toutes les décisions majeures, notamment la nomination de la direction et les objectifs stratégiques

- Conflits d’intérêts encadrés

Les membres ayant un lien financier avec la PBC doivent s’abstenir de voter sur les décisions où un conflit pourrait survenir

- Protection juridique de la mission

Les statuts précisent que l’orientation philanthropique (une AGI sure, bénéfices pour l’humanité) doit être prioritaire sur toute rentabilité .

- Rôle des procureurs de Californie et du Delaware

Ces autorités supervisent les transferts d’actifs, les chartes et la préservation de l’objet caritatif et peuvent sanctionner tout non-respect

Changements récents

Le 5 mai 2025, OpenAI a officiellement ré-organisé sa structure

- L'association reste à la tête du PBC et ne cédera pas le contrôle décisionnel

- Cette décision fait suite à fortes critiques d’anciens employés, d’ONG, d’Elon Musk, et au lobbying des AG

Malgré l’évolution structurelle, des critiques persistent :

- Des ONG telles que CANI ou Public Citizen alertent sur les risques de dérive, appelant à des garanties plus fortes pour que la mission publique soit juridiquement protégée.

- Elon Musk poursuit un recours judiciaire pour obtenir davantage de transparence ou reprendre le contrôle .

Enjeux clés à suivre

Certains points restent flous

- Taille réelle des actions du non-profit dans le PBC (non précisée).

- Détails concrets du vote structure entre non-profit et investisseurs dans la nouvelle carte d’actionnariat

Contrôle public et mission

- L’articulation entre les statuts de la PBC et la supervision des AG sera déterminante pour garantir l’exécution de la mission.

- À ce titre, le recours du Midas Project au niveau fédéral (IRS) interroge Sam Altman sur d’éventuels bénéfices personnels non alignés sur la mission

Détails de la gouvernance de la PBC du Delaware

Supervisé par la structure à but non lucratif

OpenAI, Inc. (non-profit, Delaware) détient la majorité des droits de vote sur la PBC.

Elle gouverne toujours l’ensemble de l’organisation, assurant la cohérence entre mission caritative et activités commerciales

Le Conseil du non-profit (Bret Taylor, Sam Altman, Adam D’Angelo…) supervise directement la nomination des dirigeants et les orientations stratégiques

Structure de contrôle & conflit d’intérêts

La Non‑profit contrôle la PBC via OpenAI GP LLC, manager entièrement détenu par la branche caritative

Les administrateurs liés financièrement (actions ou intérêts économiques) doivent s’abstenir de voter sur les sujets conflictuels .

Missions légales & équilibre des intérêts

La PBC est légalement tenue de conciler trois objectifs : profit, intérêt public (mission AGI), et intérêts des parties prenantes (employés, clients…) .

Ses statuts imposent que la mission (sécurité AGI, bien commun) ne soit jamais supplantée par la recherche de gains financiers

Reporting & transparence

La PBC doit produire un rapport biennal évaluant ses progrès vers la mission publique, selon les règles du Delaware PBC

Ce rapport comporte une obligation de rendre compte pour les actionnaires et parties prenantes, contribuant à la transparence.

Cadre réglementaire & surveillances externes

Les Attorneys General de Californie et de Delaware surveillent les transferts d’actifs, la gouvernance et la conformité aux obligations caritatives

Ces autorités peuvent intervenir si la mission est compromise ou si les règles PBC ne sont pas respectées.

Points de vigilance & critiques

Les ONG (CANI, groupe “Not For Private Gain”) demandent des clauses plus précises : comment le non-profit exercera son contrôle, quels critères seront utilisés, qui nommera les administrateurs…

Elon Musk et d’autres anciens fondateurs contestent la gouvernance actuelle en justice, insistant sur la nécessité de mesures plus protectrices

Chiffre d'affaires, pertes et bénéfices

CA: 2024 3,7 milliards $ +~130 % vs 2023

CA 2025 : 11,6–12,7 milliards $ ×3 de l’année

CA 2029 :125 milliards $

CA 2030: 174 milliards $ –

Annual Recurring Revenu 2025 : 10 Md$

Cash-flow positif prévu pour 2029

Marge brute estimée: 40 % actuellement, 70 % d’ici fin décennie

Marge API : segment plus rentable, estimé à 50–75 %, compensant les faibles marges de ChatGPT gratuit et ChatGPT Plus.

Pertes d'OpenAI

Déficit net 2024 : environ 5 milliards de dollars.

Déficit prévu pour 2026 : 14 milliards $

Cumul des pertes (2023–2028) : $ 44 milliards, sans inclure les dépenses en R&D

Flux de trésorerie positif prévu seulement à partir de 2029, avec des liquidités générées de 12 milliards $ cette année-là .

Business model et facteurs clés influençant la rentabilité

Le modèle s’appuie sur une forte croissance du chiffre d’affaires (+200 % par an jusqu’en 2029) couplée à une augmentaton de l'efficience sur le coût par token

Le segment API, avec des marges ancrées autour de 50–75 %, fournit une base plus saine que le modèle grand public .

À mesure que les systèmes auto-hébergés (projet Stargate, hardware dédié, CoreWeave…) se déploient, les coûts de fonctionnement devraient diminuer

Coût par token & modèle économique

En 2024, OpenAI a généré 3,7 milliards $ de CA, pour 9 milliards $ de dépenses

Le coût CPU/GPU est estimé à 0,0002‑0,0014 $ par 1 000 tokens selon A16Z, proche du tarif API de 0,002 $/1 000 tokens (selon le fonds Andreessen Horowitz).

Les modèles supérieurs (GPT‑4 Turbo à 30 $/M tokens) profitent d’une marge unitaire plus forte, la rentabilité variant selon les usages, la taille du modèle, et l’infrastructure.

Efficience hardware & infrastructure optimisée

Partenariats stratégiques

OpenAI a signé un contrat « GPU-as-a-service » de 12 Md$ sur 5 ans avec CoreWeave, inclut dans un investissement de 350 M$ dans cette société

CoreWeave optimise ses coûts d’inférence GPU de 30 à 50 % inférieurs aux hyperscalers, notamment via des GPU GB200 NVL72 (voir le détail du projet ci-après).

Ces puces réduisent le coût d’inférence (usage) de 75 % par million de tokens par rapport aux puces IA actuelles H100.

CoreWeave prévoit une économie annuelle de 500 M$ d’ici 2027.

Les principales stratégies techniques d’optimisation

- Batching & speculative decoding (traitement en lots + traitement anticipé pour réduire le calcul inutile)

- Caching de prompts (réutilisation de contextes fréquents pour diminuer l’inférence coûteuse).

- Hiérarchie de modèles (usage d’un modèle léger pour gérer la majorité des requêtes et escalade vers des LLMs puissants uniquement quand nécessaire).

- Self-hosted infrastructure (alignement avec CoreWeave, acquisition hardware interne pour réduire dépendance cloud).

Optimisation des coûts d’inférence et gains d’efficacité

| État actuel | Objectif / Effet attendu | |

|---|---|---|

| Coût d’inférence | 0,0002–0,002 $/k tokens | Valorisation selon modèle/API choisi |

| Dépense CA/revenu | 90 % (9 Md$/3,7 Md$) | Réduire via efficacité hardware |

| GPU GB200 | moins 75 % coût par rapport à une H100 | Baisse massive du coût par token |

| Architecture ASIC/Chiplet | Projets en cours | Jusqu’à 97× meilleure efficacité TCO/token |

| Méthodes d’optimisation | Batching, caching, hiérarchie de modèles | Réduction des calculs inutiles, amélioration latence |

La stratégie d'optimisation des coûts d'inférence (de traitement des requêtes utilisateurs)

Elle repose en grande partie sur les serveurs GB200 NVL72 qui consistuent un investissement stratégique pour OpenAI puisqu'ils sont:

des leviers de rentabilité,

des accélérateurs de modèle AGI (encore plus gourmand en énergie que les modèles comme GPT 4)

des piliers d’indépendance technologique.

Les GB200 NVL72 fournissent jusqu’à 30× plus de performance en inference qu'un système H100 (les puces Nvidia de référence en IA) traditionnel pour les modèles de grande taille comme Llama 3.1 (405 B paramètres).

En parallèle, les GPU H200 (successeurs de H100) offrent 40 % de performance supplémentaire sur les H100 pour Llama 2 70B

Les GB200 NVL72 permettent un coût d’inférence par million de tokens jusqu’à 75 % inférieur à celui de l’H100 (donc, un coût 4 fois inférieur), moyennant un coût plus élevé au départ.

De quoi sont composés les serveurs GB200 NVL72 ?

Le GB200 NVL72 est une super-architecture composée de :

72 GPU Blackwell (B200),

36 CPU Grace (ARM, haute bande passante mémoire),

Montés dans un rack NVLink Switch System avec interconnexion NVLink (900 Go/s entre GPU),

Consommation : ~120 kW par rack,

Débit total : jusqu'à 1,4 exaflop en FP4 (float 4-bit), 72 petaflops en FP16.

Pourquoi les GB200 NVL72 sont-ils stratégiques pour OpenAI ?

Ils permettrot de réduire les coûts d’inférence (réponses aux prompts des utilisateurs)

Le coût d’inférence représente 80–90 % des dépenses chez OpenAI (notamment sur GPT‑4o).

Le GB200 permet :

Jusqu’à −75 % de coût par token vs les H100,

Un meilleur TCO/token (Total Cost of Ownership),

Moins de serveurs pour la même tâche.

Ils permettent d'augmenter la puissance nécessaire aux futurs modèles comme GPT-5

GPT-5 nécessite :

Plus de paramètres,

Plus de contextes longs,

Plus de modalités (texte, image, audio, vidéo),

Cela implique une bande passante inter-GPU massive, que seul le NVL72 permet avec ses liens NVLink 5 et 6 de très haut débit.

Ils répondent plus rapidement, ce qui est essentiel pour les voicebots d'OpenAI

GPT‑4o (qui permet un ChatGPT en mode 100% vocal) nécessite des réponses inférieu à 300 ms.

Le GB200 permet une latence (temps de réponse) minimale. C'est un facteur clé de succès pour l’expérience vocale.

Ils sont nécessairement pour résister à la concurrence croissante de Google, Anthropic, xAI

Google travaille sur des architectures à base de TPU v5p (200 petaFLOPS) et v6 à venir,

Anthropic travaille sur de nouvelles architectures en partenariat avec AWS (Trainium2),

xAI joue la carte de la puissance brute avec ses architectures à base de centaines de milliers de GPU H100 et a passé commande de milliers de GPU B200,

OpenAI doit, donc, aligner ou dépasser la capacité de traitement de ses concurrents → le GB200 est un avantage stratégique pour cela.

Ils permettront de diminuer la dépendanc à l'Azure de Microsoft

Si OpenAI déploie ses propres racks (nom de code: Stargate project), elle peut :

Réduire la dépendance à Microsoft/Azure,

Optimiser l’efficacité énergétique (data centers dédiés),

Gérer le coût énergétique (jusqu'à 97× plus efficient par token que des GPU A100, selon Nvidia).

Comparaison GB200 vs H100

| Comparatif | |

|---|---|

| Performance inférence | GGB200 = ×30 par rapport aux H100 |

| Coût d’inférence/td> | GGB2GB200 moins 75 % par rapport aux H100 |

| Efficacité énergétique> | GB200 25× plus éco |

| PrixPrix unitaire (cloud) | 2,20 $/h (GB200) par rapport à 1 $/h (H100) estimé |

Utilisateurs et chiffre d'affaires d'OpenAI

Utilisateurs d'OpenAI

Novembre 2022 :1 million de premiers utilisateurs en 5 jours

Août 2024: 200 M de Utilisateurs hebdomadaires (Weekly Active Users)

Décembre 2024: 300 M de Utilisateurs hebdomadaires

Février 2025 : 400 M de Utilisateurs hebdomadaires

Mars/Avril–Mai 2025: 800 M de Utilisateurs hebdomadaires

Juillet 2025: 800 M de Utilisateurs hebdomadaires, avec 122 M d’utilisateurs quotidiens (+300% en moins d’un an), visant potentiellement 1 milliard de Utilisateurs hebdomadaires d’ici fin 2025 .

Février 2025: 2 millions d’utilisateurs payants « Business » (Team, Enterprise, Edu)

Juin 2025: 3 millions d’utilisateurs Business, soit +1 M en 4 mois

L’Enterprise est adopté par 92 % des entreprises du Fortune 500 .

Exemples de clients entreprises : BBVA (3 300 licences), Morgan Stanley, Lowe’s, Uber

Abonnements

ChatGPT Plus: 20 $/mois

Forfait « Pro »: $200/mois

Team/Enterprise/Edu: tarification sur volume, usage API, connecteurs, Deep Research, etc.

Agents personnalisés: facturation volume à l'usage: requêtes, stockage, exécution (ex. 2,50 $/1 000 requêtes)

Répartition des revenus 2024

CA 2024 :3,7 milliards $

ChatGPT (Plus + Business) : environ 75 % du CA, soit 2,7 Md$ sur 3,7 milliards $ .

API & autres licences: 25 %, soit 1 milliard $.

Autres statistiques

4,5 milliards de visites en mars 2025 (+0,6 milliard par rapport à février)

1 milliard de requêtes/jour

Utilisateurs quotidiens: 122 millions en 2025, ce qui correspond à environ 15 % de Utilisateurs hebdomadaires

45 % des utilisateurs ont plus de 25 ans

Pays principaux :États-Unis (~19 % des utilisateurs), Inde, Brésil, Canada, Royaume-Uni

ChatGPT reste leader du marché avec 500 millions d'utilisateurs hebdomadaires

Il domine les apps AI natives avec 160 millions d'utilisateurs quotidiens contre 35 millions pour Google Gemini

Utilisateurs hebdomadaires: 800 millions (+300% par rapport à août 2024)

Utilisateurs quotidiens 122 millions

3 millions (abonnés Team/Enterprise/Edu)

Les entreprises USA du Fortune 500 sont 92 % à utiliser OpenAI

Requêtes/jour: 1 milliard

Visites mensuelles (mars) 4,5 milliards

Utilisateurs gratuits

Ils constituent la majorité (98%) des 800 millions de Utilisateurs hebdomadaires en juillet 2025, dont ~122 millions d'utilisateurs quotidiens.

Âge (selon Nerdynav) : 18–34 ans = 56,6 %, 35–54 = 31 %, 55+ = 12 %

55 % hommes / 45 % femmes .

Abonnés ChatGPT Plus / Pro: 15,5 M d’abonnés en mai 2025

Fidélisation officielle: 71 % à 6 mois et 63 % à 9 mois .

La version Pro (200 $/mois) est encore minoritaire mais non rentable en raison d’un usage intensif .

Utilisateurs Business / Enterprise / Éducation

- 1,5 M d’utilisateurs dans Business/Team/Edu en mai 2025

- Modèles Matrices Startup+5Nerdynav+5OpenAI Help Center+5

- Adoption par 92 % des entreprises Fortune 500

Développeurs / API

- Environ 2 M de développeurs utilisent l’API

- 1 Md$ de revenu en 2024, prévu x3–4 en 2025

Fidélisation des utilisateurs

Usage gratuit / grand public

Rapport Weekly Active Users / Monthly Active Users = 40 %

Soit, pour 800 M utilisateurs hebdo, on estime ~2 milliards de MAU.

Moyenne de 6 min 25 s par session, ~3,7 pages/session, taux de rebond ~37 %

Abonnés payants

ChatGPT Plus

89 % de rétention après 3 mois, 74 % après 9 mois

Plus précisément, 71 % de fidélisation à 6 mois .

Ces indicateurs sont parmi les meilleurs du secteur, en tête des abonnements à des services IA.

Segment Business/Enterprise

IL n'existe pas de données officielles sur la fidélistion de ce segment d'utilisateurs, mais ce segment représenterait deux millions d’utilisateurs.

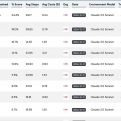

Segmentation des utilisateurs et fidélité à ChatGPT

| Utilisateurs | Nombre d'utilisateurs | Fidélisation / Usage | Commentaires |

|---|---|---|---|

| Grand public | 800 M Utilisateurs hebdomadaires | Utilisateurs hebdomadaires/MAU ≃ 40 % | Bonne activité hebdo |

| Plus / Pro | 15,5 M abonnés | 89 % à 3 mois, 71 % à 6 mois | Excellente fidélité |

| Business / Devs | 1,5–2 M utilisateurs | Non quantifié | Usage professionnel, adoption durable |

| Utilisateurs quotidiens | ~122 M | — | Représente ~15 % de Utilisateurs hebdomadaires |

Le Utilisateurs hebdomadaires:MAU de 40 % témoigne d’un niveau moyen d’engagement fréquent attendu pour une app utile mais non quotidienne comme WhatsApp ou un réseau social .

La rétention payante exceptionnelle indique une forte valeur perçue, essentielle au renouvellement d’abonnement et à la stabilité des revenus .

L’adoption étendue par les entreprises suggère une rétention plus régulière et importante usage institutionnel.

Utilisateurs par âge et sexe

Répartition par âge

- 18‑24 ans représentent plus de 45 % des utilisateurs, ce qui en fait le groupe dominant

- 25‑34 ans représentent environ 30 % de la base utilisateur .

- Ensemble, les 18‑34 ans constituent plus de 54 % des utilisateurs .

- 55‑64 ans représentent seulement 8 %

- Et le 65 ans et plus seulement 5 %

Répartition par sexe

- Globalement, 64 % d'hommes et 36 % de femmes.

- Sur la version mobile, la proportion masculine atteint 85 %

Usage selon le niveau d’éducation

Aux États-Unis début 2025, 58 % des moins de 30 ans ont utilisé ChatGPT (vs 33 % en 2023), contre 41 % pour les 30‑49 ans, 25 % pour les 50‑64 ans et seulement 10 % pour les 65+

L’usage croît avec le niveau d’éducation: 52 % des utilisateurs sont diplômés du supérieur, 51 % ont au moins une licence, contre 33 % avec bac+2 et 18 % pour les autres.

En milieu scolaire (13‑25 ans), une enquête en France et Italie (déc 2024) a montré une utilisation massive chez les étudiants, surtout les plus âgés et masculins

Usage par destination: travail, apprentissage, loisirs

États-Unis

- 28 % des adultes pour le travail (en forte hausse depuis 2023)

- 26 % pour l’apprentissage, 22 % pour les loisirs

Chez les moins de 30 ans

- 38 % utilisent ChatGPT dans un contexte professionnel

- 46 % le font pour apprendre, 42 % pour le divertissement .

Fidélisation

Le taux Utilisateurs hebdomadaires:MAU est d’environ 40 %, ce qui signifie qu’en moyenne, 4 utilisateurs actifs hebdomadaires sur 10 reviennent chaque semaine .

Les jeunes adultes (18‑24 ans) affichent les meilleures rétentions, notamment en usage éducatif ou professionnel .

Dans les cohortes payantes, la rétention à 3 trimestres (≈9 mois) atteint 74 %, bien au-delà des autres IA (20‑40 %) .

Synthèse

- Cohortes 18‑34 ans: usage élevé et rétention forte, notamment pour travail/apprentissage.

- Cohortes 30‑49 ans: usage professionnel modéré (30‑38 %) et bonne rétention.

- Cohortes 50+ : usage significativement inférieur, mais en hausse, surtout pour apprentissage.

- Cohortes payantes: fidélité très forte (89 % à 3 mois; 71 % à 6 mois)

Les utilisateurs intensifs d'OpenAI: les power users

Définition des power users

Selon l’étude conjointe d’OpenAI et du MIT Media Lab, les « power users » sont définis comme ceux dont l’usage en Advanced Voice Mode les place dans le top 1 000 en volume de messages sur une journée ; une fois identifiés, leurs échanges sont suivis longitudinalement sur plusieurs mois

Usage intensif & profils

Même chez les utilisateurs intensifs, seuls quelques-uns manifestent un usage profondément affectif (émotionnel), impliquant des échanges plus personnels .

Ces power users ont tendance à utiliser abondamment les modes vocal et textuel, souvent comme substitut social ou compagnon.

Impact émotionnel

Environ 3 000 000 conversations consiste en des échanges non utilitaires et "émotionnels".

Ces utilisateurs déclarent une attachment émotionnel, voire considèrent ChatGPT comme un ami, et rapportent des niveaux plus élevés de solitude, dépendance et usage problématique

Ressources humaines et culture d'entreprise d'OpenAI

Évolution des effectifs

Une croissance rapide (770 collaborateurs en nov. 2023 → 3 531 employés en sept. 2024).

Juin 2025 estimé entre 2 660 et 6 300 employés selon certaines sources

Si l’on retient l’estimation conservatrice, OpenAI a embauché ~973 personnes en 12 mois (croissance de 45 %), avec un turnover d’environ 5 %

Le département ingénierie représente 56 % des effectifs (~1 480 personnes)

Répartition par département

1 480 en ingénierie (56 %)

233 en business management (~9 %)

225 en marketing & produit (~8 %)

212 en RH (~8 %)

458 en finance, support, legal, IT (17 %)

Autres: 50 personnes

Culture de travail & ambiance

Ambiance intense, style start-up

En 2024–2025, les employés ont vécu une phase d’« hyper-expansion », accompagnée de chaos organisationnel, communication fragmentée, imbriquements de responsabilités et réorganisations fréquentes

Exemple: lancement de Codex en 7 semaines a impliqué 70‑80 h de travail hebdo, nuits blanches, sprints de week-end — « l’un des pires rythmes de travail de ma dernière décennie »

Communication ultra-Réactive

OpenAI privilégie Slack à l’email

un ex-ingénieur rapporte n’avoir reçu que 10 emails en 12 mois — tout passe par Slack, souvent source de distraction mais jugé maîtrisable

Le rythme est marqué par un besoin de réactivité constante, souvent jusqu’à 12h par jour .

Pression & gouvernance du silence

Les licenciements sont gérés dans la discrétion, souvent sans communication formelle, créant un environnement parfois tendu et perçu comme psychologiquement difficile .

Bien que passionnée et qualifiée (« parmi les meilleurs de la tech »), la culture est jugée émotionnellement intense .

Responses internes & initiatives

Face à la concurrence (offres de salaires records de Meta), l’équipe dirigeante (Mark Chen, Sam Altman) a engagé un plan de rétention comprenant message direct, augmentation de la rémunération, semaine de récupération pour staff, invitation à dialoguer en cas de contre-offres

Critères de recrutement

OpenAI privilégie curiosité, esprit d’initiative et débrouillardise plus que les diplômes ou Ph.D, valorisant la “agency” et la capacité à résoudre des problèmes de façon autonome

Enjeux & risques

Burnout (longues journées, attente de disponibilité permanente, retours d’expérience (Codex, GPT releases) montrent une culture de performance extrême).

Flux de talents (pression concurrentielle croissante, notamment via les super-offres de Meta, obligeant l’entreprise à renforcer la rétention).

Structure & gouvernance (croissance rapide entraîne un besoin constant de synchronisation interne, processus et transparence — domaines restant fragiles).

Synthèse du contexte RH d'OpenAI

| Détails | |

|---|---|

| Effectifs | 2 600–6 300 employés, ~56 % ingénierie |

| Croissance | +45 % de recrues en 12 mois, turnover ~5 % |

| Culture de travail | Intense, cycles courts, pression élevée, Slack omniprésent |

| Risques humains | Burnout, stress, manque de communication sur licenciements |

| Actions managériales | Rétention active, surplus salarial, soutien psychologique |

Avantages et incentives des employés d'OpenAI

Profit Participation Units (PPU)

OpenAI accorde à ses salariés des Profit Participation Units (PPU), une forme de participation aux bénéfices typique des LLC.

Chaque PPU donne droit à un pourcentage des profits futurs, jusqu’à une limite fixée :

- La côte possible est plafonnée à 10× la valeur initiale du PPU

- La plupart des PPU sont évalués sur la base des prix payés lors de tender offers (offres de rachat annuelles ou biannuelles par des investisseurs comme SoftBank)

Délai de vesting & liquidités

Les PPU sont attribués à 4 ans, avec une libération de 25 % par an

Une clause de lock-in de 2 ans empêche la revente immédiate après attribution, pour les nouveaux titulaires .

Les ordres de rachat permettent aux employés de vendre leurs PPU (valeur alignée sur le dernier prix par PPU)

Potentiel de compensation

Exemple typique: salaire de base ~300 000 $/an + PPU équivalant à 2 M$, totalisant ~800 000 $/an si PPUs perçus

En cas de succès, la valeur maximum perçue par employé peut atteindre ~20 M$ (PPU * 10) .

Importance dans la stratégie de fidélisation des employés

En 2023, les charges liées à l’équité pour les effectifs ont atteint 4,4 Md$, soit l’équivalent de 119 % du chiffre d’affaires annuel (3,7 Md$) .

Cette part devrait diminuer à 45 % en 2025, puis à moins de 10 % vers 2030, tout en restant un levier clé pour concurrencer les offres de Meta

Face à l’Université de talents Meta, OpenAI a recalibré les salaires et renforcé l’équité pour retenir ses chercheurs et ingénieurs

Comparaisons avec les modèles classiques d'incentives

Contrairement aux RSU ou stock-options, les PPUs ne nécessitent aucun investissement initial et ne sont pas imposés à l’émission, mais seulement lors de la vente (imposition en plus-value)

À la différence d’un RSU, le PPU conserve une structure d’incitatif fortement alignée sur le succès financier brut – et non sur la valorisation boursière.

Structure des incitives employé en equity chez OpenAI

| Détails | |

|---|---|

| Type d’équité | Profit Participation Units (PPU) |

| Vesting/délai de lock-in | 4 ans vesting, 2 ans lock-in pour les nouveaux |

| Plafond | x10 la valeur initiale |

| Liquidité | Tender offers bi-annuels ou annuels |

| Coût interne | 4,4 Md$ en 2023 (≈119 % du CA) |

| Potentiel | Jusqu’à 20 M$ par employé |

| Avantage fiscal | Imposition sur plus-value |

| Rétention | Outil clé pour retenir ingénieurs/chercheurs |

| Comparatif | PPUs ≠ RSUs ; intérêt centré sur le profit, non la valorisation |

Les technologies software et hardware d'OpenAI

Modèles & innovation logicielle

GPT‑4o (Omni) – lancé mai 2024

Modèle multimodal (texte, image, audio, vidéo) en temps réel, avec latences de ~320 ms et coût API réduit de 50 % par rapport à GPT‑4 Turbo, tout en maintenant ses capacités textuelles, code et multitâches

GPT‑4.1, GPT‑4.1 mini/nano – API sortie en avril 2025

Meilleurs scores en codage, compréhension contextuelle (jusqu’à 1 million de tokens de contexte) que GPT‑4o

Sneak peek GPT‑5 prévue pour l’été 2025, fusionnant chaînes de raisonnement (O-series) et capacité multimodale de GPT‑4o, avec potentiellement unifier toute la gamme de modèles

Infrastructure matérielle – partenariats clés

CoreWeave (GPU-as-a-Service)

Contrat de 11,9 Md$ sur 5 ans, incluant 350 M$ d’actions CoreWeave, pour fournir des centaines de milliers de GPU NVidia dédiés

Ce partenariat réduit les coûts d’inférence tout en offrant de la capacité élastique.

Stargate LLC

Co‑venture (OpenAI 40 %, SoftBank 40 %, Oracle/MGX) évaluée à 500 Md$ d’infrastructure sur quatre ans (100 Md$ initiaux), incluant 10 data centers US, projets internationaux (Japon, EAU)

SoftBank finance massivement, OpenAI pilote les opérations terrain.

Diversification cloud – Google Cloud, TPUs

Depuis mai 2025, ajout de Google Cloud/Tensors TPUs dans le mix pour éviter la dépendance à Azure ; accord confirmé début juillet

Toujours Azure mais désormais multi-cloud pour résilience et négociation de coûts.

Développement interne

Collaboration depuis 2024 avec Broadcom/TSMC pour des puces sur mesure ASIC destinées à l’inférence en 2026

Acquisition de IO (Jony Ive) pour décliner hardware pensé “AI-first”

Coûts, efficience & scalabilité

Apports massifs, mais OpenAI n’est "plus compute-constrained" selon Sam Altman, grâce aux optimisations (GPT‑4.5 permet de recréer GPT‑4 avec 5–10 personnes

Utilisation de GPU GB200 (voir section hardware) est soutenue par cette infrastructure.

KPI internes (coût/token, énergie) optimisés par CoreWeave, puces maison, batching/caching (voir sections précédentes).

Sécurité, supervision & déploiement

Stargate assure sécurité physique (data centers dédiés aux États-Unis, soutien national) et conformité (« benefit corporation » liée à mission AGI).

Reporting & lead

poste dédié assurant suivi des coûts et planning de déploiement chez OpenAI

Modèle « Model Spec » (internal) guide les comportements attendus des modèles à toutes les strates

Modèles accessibles via ChatGPT.com (interface web et mobile)

GPT‑4.1

C’est le modèle premium accessible uniquement aux utilisateurs payants (abonnement Plus ou Enterprise). Il est performant sur les tâches complexes comme le codage, l’analyse de texte ou les interactions longues. Il supporte un contexte allant jusqu’à 32 768 tokens dans l’interface web, et jusqu’à 1 million de tokens via l’API.

GPT‑4.1 mini

Ce modèle est désormais utilisé par tous les utilisateurs (gratuits et payants) en tant que modèle par défaut. Il remplace GPT‑4o mini. Il offre un excellent compromis entre rapidité, qualité et coût.

GPT‑4o

Il s’agit du modèle multimodal (texte, image, voix) utilisé par défaut pour les conversations vocales en temps réel. Il permet des interactions naturelles avec des latences de l’ordre de 320 millisecondes, et accepte un contexte de 128 000 tokens.

GPT‑4o mini

Version allégée de GPT‑4o, conçue pour des interactions plus économiques mais toujours multimodales. Elle est utilisée en arrière-plan pour les utilisateurs gratuits ou les cas d’usage à faible intensité.

Modèles disponibles via l’API OpenAI

GPT‑4.1 (standard)

Le modèle le plus avancé via l’API, adapté au développement d’agents complexes, d’applications de codage, ou de traitement de documents très volumineux. Il accepte jusqu’à 1 million de tokens en entrée, et coûte 25 dollars pour 1 000 appels API, incluant tous les tokens.

GPT‑4.1 mini

Variante plus rapide et plus économique, tout en conservant un très bon niveau de performance. Également limitée à 1 million de tokens de contexte, elle est idéale pour la majorité des applications grand public ou professionnelles.

GPT‑4.1 nano

Encore plus rapide et allégée, cette version est parfaite pour des tâches simples comme de l’autocomplétion, du tri ou des réponses brèves.

GPT‑4o (et sa version mini)

Accessible aussi via l’API, ce modèle gère la voix, l’image et le texte. Le coût est d’environ 0,0025 $ par 1 000 tokens en entrée et 0,01 $ par 1 000 tokens en sortie, avec 128k tokens de contexte.

GPT‑4 Turbo

Ancien modèle phare, encore supporté pour des usages à 128k tokens de contexte. Moins performant que GPT‑4.1 mais souvent utilisé pour les tâches nécessitant un grand volume de mémoire.

GPT‑3.5 Turbo

Toujours disponible, il offre 16 000 tokens de contexte et reste le choix le plus économique, bien que moins précis ou performant sur des tâches avancées.

Série des modèles “o” (o1, o3, o4…)

Ces modèles, peu connus du grand public, sont conçus pour le raisonnement complexe, les usages scientifiques, ou les chaînes de pensée. Par exemple, o1 coûte jusqu’à 150 $ pour 1 million de tokens en entrée et 600 $ pour 1 million de tokens en sortie, ce qui en fait une solution réservée aux cas ultra-spécialisés.

Recommandations d’usage

- Pour des usages classiques (chat, résumé, écriture) → GPT‑4.1 mini ou GPT‑4o mini suffisent.

- Pour des projets techniques, agents ou analyse longue → GPT‑4.1 est le plus adapté.

- Pour les interfaces vocales, multimédia, image → GPT‑4o est le modèle clé.

- Pour économiser ou traiter des tâches simples → GPT‑3.5 Turbo ou GPT‑4.1 nano sont idéaux.

- Pour les usages de recherche ou d’intelligence avancée → privilégier les modèles o1 / o3 / o4 si le budget le permet.

GPT‑4.1 (API)

Cas d’usage

codage complexe, agents interactifs, analyses longues, applications business premium.

Contexte: jusqu’à 1 M de tokens ; max 32 768 tokens en sortie

Performance: +21 % en codage vs GPT‑4o, +10 % en compréhension d’instruction .

Prix

environ 2 $/1 M tokens en entrée, 8 $/1 M en sortie .

Recommandations: idéal pour réécriture de code, extraction structurée, agents à étapes multiples (use “chain‑of‑thought” prompts) .

GPT‑4.1 mini

Cas d’usage: rapidité requise, équilibré pour usage général (chat, résumé, classification).

Contexte: jusqu’à 1 M tokens .

Performance

performance proche de GPT‑4.1 complète, meilleure efficacité .

Prix: 75 % moins cher que la version complète .

Recommandations: parfait pour workflows volumineux ou intégrations légères nécessitant de la cohérence.

GPT‑4.1 nano

Cas d’usage: tâches simples et légères (autocomplétion, filtrage, classification).

Contexte: jusqu’à 1 M tokens .

Prix : encore plus abordable que la version mini .

Recommandations: préférer pour les applications à faible latence et gros volumes, comme routage ou taggage.

GPT‑4o (Omni)

Cas d’usage: multimodalité riche (voix, image, texte), assistances vocales, OCR, traductions en temps réel.

Contexte: 128 000 tokens .

Performance: deux fois plus rapide, deux fois moins cher que GPT‑4 Turbo .

Prix : $0,0025 input / $0,01 output par 1 000 tokens .

Recommandations: à utiliser pour intégration dans apps mobiles, voice bots, analyse visuelle à haute fréquence .

GPT‑4o mini

Cas d’usage: multimodal à budget réduit, tâches simples (extraction image, debug, OCR léger).

Contexte: similaire à GPT‑4o.

Performance: bon compromis vitesse/coût/performance .

Recommandations: à privilégier en pré-traitement ou tâches fréquentes à petite échelle.

GPT‑4 Turbo (API)

Cas d’usage: contextes moyens (≤ 128k tokens), usages textuels complexes sans multimodalité.

Prix: $0.01 prompt / $0.03 completion par 1 000 tokens.

Recommandations: utile pour NLP intensif (résumé, classification) sans besoin multimodal.

GPT‑3.5 Turbo

Cas d’usage: chatbots économiques, workflows simples, prototypage.

Contexte: 16k tokens.

Prix: très abordable (info factuelle non précisée ici).

Recommandations: Convient aux petits projets nécessitant flexibilité à moindre coût.

Modèles “o‑series” (o1, o3, o4‑mini…)

Cas d’usage: recherches scientifiques, calculs complexes, chaînes de raisonnement sophistiquées.

Performance : haute précision pour tâches STEM.

Prix: o1 => $150/1 M tokens input + $600/1 M tokens output .

Recommandations: réservés aux laboratoie, analyses financières ou IA forte quand le budget le permet.

Les défis que doit relever OpenAI

Risques liés à la sécurité & à l’AGI

Une enquête du Future of Life Institute juge les pratiques actuelles pour garantir la sécurité face à l’AGI comme insuffisantes (grade C pour OpenAI)

Il n’existe pas encore de stratégie complète et concrète pour gérer les risques existentiels

Le rapport compare ce manque de planification à la mise en marche d’une centrale nucléaire sans garanties de sécurité.

Régulation & conformité légale

Le Code of Practice de l'UE entré en vigueur le 2 août 2025 impose des évaluations de risques strictes et menace les fournisseurs d’IA de sanctions allant jusqu’à 7 % du chiffre d’affaires

États-Unis

malgré des législations au niveau des États, il n’existe pas encore de cadre fédéral clair. OpenAI a plaidé pour un « regulatory sandbox », mais certains comme Elon Musk ou des législateurs expressent des craintes sur le dérèglement réglementaire .

Défis de sécurité modèle

Prompt injection : attaque où l’utilisateur ou la donnée manipulée détourne les instructions ou les outils du modèle. Wikipedia souligne des vulnérabilités identifiées dans ChatGPT dès 2024

OpenAI publie des System Cards pour chaque modèle (o-series, GPT-4o, Operator…), détaillant les tests de sécurité, la résistance aux attaques, les limites détectées

Litiges & risques juridiques

OpenAI est poursuivi aux États-Unis, Canada, Inde pour utilisation non autorisée de contenus protégés. En mars 2025, seul le cas du New York Times a partiellement survécu

poursuites en cours pour collecte non consentie de données, dont YouTube et d'autres sources .

OpenAI a témoigné devant le Sénat américain sur les contraintes d’exportation des puces IA et les restrictions face à la Chine

Concurrence & fuite des talents

OpenAI reste leader, mais Meta, Google, xAI ou Amazon intensifient leurs efforts.

Meta propose des salaires jusqu’à 300 M$ sur 4 ans. OpenAI doit combiner attractivité financière et mission éthique pour retenir ses équipes

Risques institutionnels & stratégiques

La structure hybride (PBC non-profit + pour‑profit) crée des risques de dilution de mission, selon certains observateurs, jusqu’à menacer la confiance des investisseurs

Le projet Stargate (500 Md$ d'infra) avec SoftBank, Oracle, Microsoft peut être ralenti par incertitudes politiques ou régulatoires .

Gestion des risques émergents

OpenAI a mis en place un système de scorecard mesurant le niveau des modèles (du “high” au “critical”) avant déploiement

Le projet de poids ouverts (open-weight) de GPT-5 a été repoussé plusieurs fois afin de renforcer les tests de sécurité

OpenAI encourage une régulation axée sur des standards de référence, des audits de sécurité, et une surveillance post-déploiement .

✅ Synthèse des principaux défis

- Catégorie ➡ Risques clé

- Sécurité AGI ➡ Manque de planification existentiel, classement médiocre par FLI

- Régulation ➡ Pression juridique UE (AI Act), incertitudes US

- Sécurité modèle Prompt injection, attaques logiques, besoin de red teaming

- Responsabilité légale ➡ Litiges Droit d’auteur, scraping, régulation d’export, vie privée

- Ressources humaines ➡ Concurrence féroce, retention vs éthique

- Gouvernance ➡ Complexité PBC, dilution de mission, contrats critiques

- Déploiement & usage ➡ Risque malveillant, scarification (outil intern), tests insuffisants

Litiges & risques juridiques

Affaire The New York Times v. OpenAI & Microsoft

Le 27 décembre 2023, le New York Times a attaqué OpenAI et Microsoft, les accusant d’avoir utilisé "des millions" d’articles sans autorisation pour entraîner ChatGPT, entraînant des pertes de revenus et concurrence déloyale

En mars–avril 2025, le juge Sidney Stein a rejeté la majeure partie de la requête d’OpenAI, confirmant que les allégations de reproductions textuelles directes (regurgitation) étaient recevables

Ce litige est devenu central, avec la consolidation de plusieurs procédures contre OpenAI (auteurs majeurs comme George R.R. Martin, Sarah Silverman, major publishers) dans le district sud de New York

Dossier avancé vers la phase de découverte, ce qui pourrait exposer OpenAI à des dommages-intérêts très élevés (milliards de dollars).

Une issue défavorable pourrait créer un précédent limitant l’usage de données publiques sans licence explicite.

Protection de la vie privée

En mai 2025, le New York Times a demandé à la justice d’exiger la conservation permanente de tous les logs d’utilisateur, y compris ceux supprimés

OpenAI a contesté cette décision, arguant d’une violation grave des engagements de confidentialité, et a formalisé un appel en juin 2025

Si l’ordre était maintenu, cela fragiliserait la confiance utilisateur et créerait un précédent juridique dangereux pour la confidentialité des échanges IA.

Poursuites contre la collecte de données & scraping

En juin 2023, un recours collectif en Californie dénonçait le scraping de 300 milliards de mots sans consentement, y compris des données personnelles

En novembre 2024, un groupe canadien de médias (Toronto Star, Globe & Mail…) a déposé plainte similaire pour violation de droits – cause toujours en cours en 2025

Cette procédure ouvre la voie à des actions en justice coûteuses pour violation de la vie privée ou contrats, avec des conséquences potentielles sur la collecte et la rétention de données par OpenAI.

Litiges contre les créateurs individuels

En juillet–sept. 2023, des auteurs tels que Sarah Silverman, Paul Tremblay, Jonathan Franzen, George R.R. Martin et d’autres ont attaqué OpenAI pour inclusion de leurs œuvres dans les modèles sans licence

À ce jour, certaines parties ont été rejetées, mais des poursuites restent ouvertes sur la base de la façon dont les données sont utilisées et reproduites.

Risques techniques & juridiques liés à la “regurgitation”

Le concept de “memorization”, aka régurgitation, fait l'objet de débats fondamentaux

une réponse générée ressemblant beaucoup à un texte original joue un rôle central dans la définition du délit de droit d’auteur

Même si OpenAI défend la légalité de son entraînement via le “fair use”, la ligne est fine entre “transformation” et copie substantielle — et les juges y prêtent attention.

Synthèse des litiges juridiques

- NYT & grands médias ➡ Procès avancé en phase de découverte ➡ Remboursement potentiellement élevé, changement de pratiques

- Conservation des données utilisateurs ➡ OpenAI fait appel contre l’ordre ➡ Atteinte à la confidentialité et à la confiance

- Scraping & collecte ➡ Affaires civiles au Canada & CA en cours ➡ Sanctions financières, modulation du dataset

- Auteurs individuels ➡ Certaines causes rejetées, d’autres actives ➡ Risques de reproches + mise à jour des licences

- Regurgitation & mémoire ➡ Définition juridique floue, contestée ➡ Changements potentiels dans le traitement de données

Les perspectives d'OpenAI pour 2025-2027

Renforcer la sécurité & préparatifs AGI

Renforcer le « Preparedness Framework »

Accélérer la mise en œuvre des mesures opérationnelles récemment définies pour les risques sévères liés aux modèles de type AGI (poids lourd à critiques)

Industrialiser le red-teaming au-delà des tests internes

Intégrer des audits tiers, des simulations d’utilisation malveillante, et une validation via des comités indépendants, à l’image des recommandations NIST .

Anticipation réglementaire & conformité proactive

Anticiper l’application de l’AI Act

Structurer des équipes internes UE‑US pour cartographier les exigences, tester la conformité (algorithmic impact assessments…) avant la mise en vigueur de l’acte pour éviter les amendes.

Consolider la démarche de sandbox réglementaire en collaboration avec les autorités (USA, UE), afin de garantir que les innovations (multimodalité, voice commerce…) restent auditées et expliquées.

Gestion des litiges et adaptation des pratiques juridiques

Renégocier les licences de contenu massives

Réduire le risque de « regurgitation » en signant des accords globaux avec les éditeurs (NYT, grands groupes), réduisant simultanément les enjeux financiers et éthiques.

Sécuriser la conservation des données

2tablir une politique transparente et juridiquement défendable concernant la durée de stockage des conversations utilisateur, afin d’éviter une rupture de confiance et préserver la confidentialité .

Culture interne & guerre des talents

Renforcer le bien-être au travail

Traduire les engagements en actions concrètes (heures maximales, recharge obligatoire, formation continue, diversité des cadres) face aux signaux de burnout et à l’attrait salarial de la concurrence .

Valoriser la mission non financière

Promouvoir publiquement les engagements éthiques (PBC, sécurité AGI, charte de mission) pour attirer les talents engagés plutôt qu’hédonistes.

8.5. Stratégie produit & diversification des revenus

Monétiser les flux gratuits via e‑commerce vocal

En intégrant—avec transparence—un système de checkout sur chat, OpenAI peut capter des commissions tout en conservant l’engagement des utilisateurs

Optimiser la diversification hardware‑software

Poursuivre la stratégie d’IO/Jony Ive pour lancer des produits intégrés (casques, assistants domestiques), renforçant le foyer comme nouveau point d’ancrage IA

8.6. Infrastructure & souveraineté technologique

Poursuivre le projet Stargate

Accélérer la construction de centres de données « souverains » aux États-Unis et en Europe afin de sécuriser les opérations et contrer les risques géopolitiques .

Diversifier les fournisseurs cloud

Réduire la dépendance à Azure et Nvidia en multipliant les partenariats (TPU, CoreWeave, TPUs Google) pour améliorer à la fois le pouvoir de négociation et la résilience.

Transparence & dialogue sociétal

Tisser un dialogue éthique public‑privé

Organiser des panels avec ONG, agences régulatrices, think tanks pour communiquer de manière proactive sur la sécurité, l’usage des données et les transformations culturelles liées à l’IA.

Améliorer la lisibilité des documents publics

Rendre le Preparedness Framework et le Preparedness scorecard accessibles en langage clair pour favoriser la pédagogie sur l’IA et éviter la méfiance

Et pour terminer, voici la feuille de route pour 2025.

Feuille de route OpenAI 2025

Axe 1 – Sécurité & Préparation AGI

| Objectif | Livrable | Échéance | Responsable | Résultat attendu |

|---|---|---|---|---|

| Finaliser le *Preparedness Framework* v2 | Publication publique + documentation dev | 30 sept. | Head of Safety | Base standardisée de sécurité IA |

| Lancer le *Red Teaming Network* externe | Portail de recrutement + API d'injection tests | 31 oct. | VP Trust & Safety | Évaluation continue par tiers |

| Étiqueter tous les modèles par niveau de risque AGI | Scorecards pour GPT‑4o et futurs | 15 nov. | OpenAI Governance Board | Transparence accrue pour partenaires et presse |

Axe 2 – Régulation & conformité proactive

| Objectif | Livrable | Échéance | Responsable | Résultat attendu |

|---|---|---|---|---|

| Préparer conformité AI Act (UE) | Audit interne + fiches d'impact modèle | 30 nov. | Legal & Compliance | Anticipation des contrôles en 2026 |

| Renforcer documentation API sur la vie privée | Politique RGPD + datavisualisation des flux | 31 oct. | Product Legal Counsel | Réduction du risque de litige |

Axe 3 – Juridique & gestion des litiges

| Objectif | Livrable | Échéance | Responsable | Résultat attendu |

|---|---|---|---|---|

| Négocier accords de licence avec 5 grands médias | Framework standard de licensing data | 15 déc. | Partnerships + General Counsel | Réduction des litiges NYT & co. |

| Réviser politique de conservation des logs utilisateurs | Rapport de conformité + lobbying FTC | 30 nov. | Privacy Officer | Alignement juridique et réputationnel |

Axe 4 – Culture, talents & gouvernance

| Objectif | Livrable | Échéance | Responsable | Résultat attendu |

|---|---|---|---|---|

| Lancer programme de rétention des chercheurs seniors | Plan d’équité + roadmap “mission-driven” | 30 sept. | People Operations | Baisse du turnover R&D |

| Refonte du Board PBC avec observateurs indépendants | Annonce + nouvelle charte | 15 déc. | Sam Altman / Legal | Crédibilité renforcée de la gouvernance hybride |

Axe 5 – Produit & diversification monétaire

| Objectif | Livrable | Échéance | Responsable | Résultat attendu |

|---|---|---|---|---|

| Piloter tests de “voice commerce” avec GPT‑4o | Plugin avec Stripe + UX vocale | 30 nov. | Head of Monetization | Nouveaux revenus B2C |

| Déploiement restreint d’un assistant vocal hardware (projet Jony Ive) | Prototype + feedback utilisateurs | 15 déc. | Applied Team | Positionnement différenciant face à Alexa |

Axe 6 – Infrastructures & souveraineté

| Objectif | Livrable | Échéance | Responsable | Résultat attendu |

|---|---|---|---|---|

| Avancer sur le centre de données Stargate (phase 1) | MOA opérationnelle + planification énergétique | 15 nov. | CIO + SoftBank liaison | Sécurisation long terme de l’infra |

| Signer un contrat secondaire avec fournisseur hors Azure | Contrat cloud ou GPU souverain | 31 déc. | Procurement | Réduction dépendance Microsoft |

Indicateurs transversaux de pilotage

| KPI | Cible Q4 2025 |

|---|---|

| Satisfaction partenaires régulateurs | > 80 % |

| Taux de couverture RGPD/API en conformité | 100 % |

| Dépendance Azure/Nvidia en % des requêtes | < 70 % |

| Taux de rétention des PhD seniors | > 90 % |

| Nombre de contenus sous licence active | > 5 M articles |

| Vitesse de réponse moyenne vocale (GPT‑4o) | < 700 ms |