Guide de la mise en production des applications n8n

Voici un guide décrivant les étapes essentielles du déploiement d'application n8n en production.

Sommaire

- Préparation Stratégique

Analyse ROI, cartographie des risques, et stratégie multi-environnements.

- Architecture de Production

Configuration PostgreSQL optimisée, intégration Redis, et sauvegardes automatisées.

- Sécurité Industrielle

Hardening des instances Docker, gestion des secrets, et audit RGPD.

- Déploiement Continu

Intégration GitOps, pipeline CI/CD avec checks, et stratégie Blue/Green.

- Monitoring de Prod

Centralisation des logs, métriques clés à surveiller, et alertes intelligentes.

- Maintenance Évolutive

Procédures de rollback, gestion des dépendances, et mises à jour zero-downtime.

- Cas Spéciaux

Gestion des workflows critiques et intégrations IA sécurisées.

I. Stratégie

1. Audit des processus métier

Avant de mettre en production une application développée sous n8n, il est essentiel de procéder à un audit approfondi des processus métier. Cette étape permet de garantir que les workflows automatisés répondent efficacement aux besoins opérationnels tout en minimisant les risques d'erreur ou de dysfonctionnement.

Objectifs de l’audit

- Identifier les processus critiques

- Repérer les tâches stratégiques qui nécessitent une automatisation fiable et performante.

- Définir les priorités

- Classer les workflows selon leur impact sur l’entreprise (gain de temps, réduction des coûts, amélioration de la qualité).

- Évaluer la faisabilité technique

- Vérifier que les intégrations et connecteurs utilisés dans n8n sont compatibles avec les systèmes existants.

- Détecter les points de blocage potentiels

- Identifier les étapes du processus où des erreurs ou des retards pourraient survenir.

Méthodologie

1. Cartographie des processus métier

Listez tous les workflows existants dans l’entreprise.

Documentez chaque étape du processus, en précisant les acteurs impliqués, les outils utilisés et les données manipulées.

Utilisez des diagrammes (ex. BPMN) pour visualiser les flux d’information.

2. Analyse des performances actuelles

Mesurez le temps nécessaire pour accomplir chaque tâche manuelle.

Identifiez les goulets d’étranglement ou inefficacités dans le processus actuel.

Collectez des retours d’expérience auprès des équipes opérationnelles.

3. Définition des objectifs d’automatisation

Fixez des indicateurs clés de performance (KPI) pour chaque workflow automatisé (ex. réduction du temps d’exécution, diminution du taux d’erreur).

Déterminez le niveau de complexité acceptable pour chaque automatisation.

4. Validation avec les parties prenantes

Présentez vos conclusions aux équipes concernées (IT, métiers).

Obtenez leur accord sur la priorité des workflows à automatiser et sur la stratégie globale.

Outils recommandés

- Diagrammes Visio ou Draw.io pour cartographier les processus.

- Outils d’analyse comme Excel ou Power BI pour mesurer l’efficacité actuelle.

Plateformes collaboratives (ex. Notion, Confluence) pour centraliser la documentation.

Résultat attendu

À l’issue de cette étape, vous disposerez

- D’une vue claire et exhaustive des workflows à automatiser.

- D’une liste priorisée des processus critiques à intégrer dans n8n.

- D’un consensus entre toutes les parties prenantes sur la stratégie d’automatisation.

I. Préparation Stratégique

2. Analyse ROI des automatisations

Une analyse approfondie du retour sur investissement (ROI) est cruciale pour justifier la mise en production des workflows automatisés développés sous n8n. Cette étape permet de mesurer l’impact économique et opérationnel des automatisations sur l’entreprise, tout en optimisant les ressources dédiées au projet.

Objectifs de l’analyse ROI

Quantifier les bénéfices de l’automatisation

Identifier les gains financiers et opérationnels générés par la réduction des tâches manuelles.

Évaluer les coûts associés

Prendre en compte les coûts directs (infrastructure, licences, maintenance) et indirects (formation, temps d’intégration).

Prioriser les workflows rentables

Concentrer les efforts sur les automatisations qui offrent le meilleur rapport coût/bénéfice.

Anticiper les économies à long terme

Projeter les impacts positifs sur la productivité et la qualité des services.

Méthodologie

1. Identification des coûts

Listez les investissements nécessaires pour mettre en production n8n (serveurs, bases de données, connecteurs tiers).

Intégrez les coûts liés au développement initial des workflows (temps des développeurs, tests).

Ajoutez les frais récurrents comme la maintenance ou les mises à jour.

2. Estimation des bénéfices

Calculez le temps économisé grâce à l’automatisation (ex. heures de travail réduites).

Évaluez la diminution des erreurs humaines et leurs impacts financiers.

Mesurez l’amélioration de la satisfaction client ou des délais de livraison.

3. Calcul du ROI Utilisez la formule suivante pour chaque workflow $$

ROI = \frac{\text{Bénéfices nets}

\text{Coûts totaux}}{\text{Coûts totaux}} \times 100

$$

Exemple

Si un workflow économise 10 000 € par an et coûte 2 500 € à développer et maintenir, le ROI serait $$

ROI = \frac{10\,000

2\,500}{2\,500} \times 100 = 300\%

$$

4. Analyse comparative

Comparez le ROI des différents workflows pour identifier ceux qui offrent le meilleur potentiel.

Classez-les par priorité en fonction de leur impact stratégique.

5. Validation avec les décideurs

Présentez vos calculs aux équipes dirigeantes.

Obtenez leur approbation pour investir dans les workflows prioritaires.

Outils recommandés

Tableurs comme Excel ou Google Sheets pour calculer le ROI.

Logiciels d’analyse financière (ex. Tableau, Power BI) pour visualiser les projections économiques.

Outils de gestion de projet (ex. Trello, Jira) pour suivre l’avancement des automatisations.

Résultat attendu

À la fin de cette étape, vous disposerez

D’un rapport détaillé sur le ROI de chaque workflow automatisé.

D’une liste priorisée des automatisations à mettre en production en fonction de leur rentabilité.

D’un alignement stratégique entre les équipes techniques et décisionnelles.

I. Préparation Stratégique

3. Cartographie des risques techniques

La cartographie des risques techniques est une étape essentielle pour anticiper les problèmes pouvant survenir lors de la mise en production des workflows automatisés sous n8n. Elle permet de minimiser les interruptions, d’assurer la stabilité du système, et de garantir une expérience utilisateur optimale.

Objectifs de la cartographie

Identifier les points de défaillance potentiels

Repérer les éléments critiques du workflow susceptibles de provoquer des erreurs ou des interruptions.

Évaluer les impacts des risques

Mesurer l’effet d’un problème technique sur les opérations métier et sur les utilisateurs finaux.

Planifier des solutions de contournement

Définir des mécanismes pour gérer rapidement les incidents et réduire leur impact.

Renforcer la résilience du système

Mettre en place des stratégies pour prévenir les défaillances.

Méthodologie

1. Analyse des dépendances techniques

Listez tous les composants nécessaires au fonctionnement des workflows (bases de données, API externes, connecteurs tiers).

Identifiez les dépendances critiques (ex. une API externe indispensable à un workflow).

Évaluez la robustesse et la disponibilité de ces composants (ex. SLA des services tiers).

2. Identification des scénarios de risque

Pannes matérielles ou réseau.

Saturation des ressources (CPU, mémoire, stockage).

Défaillances dans l’exécution des workflows (ex. timeout d’une API).

Erreurs liées aux données (ex. format incompatible ou données manquantes).

Vulnérabilités en matière de sécurité (ex. fuite de secrets ou attaques externes).

3. Évaluation du niveau de gravité Classez chaque risque selon deux critères

Probabilité d’occurrence

Faible, moyenne ou élevée.

Impact potentiel

Mineur, modéré ou critique.

Utilisez une matrice de risque pour visualiser ces informations.

4. Planification des mesures préventives

Implémentez des mécanismes de reprise automatique en cas d’échec (retry logic dans n8n).

Configurez des sauvegardes régulières pour protéger les données critiques.

Testez la tolérance aux pannes en simulant différents scénarios.

5. Définition d’un plan d’urgence

Créez une procédure claire pour gérer les incidents techniques (ex. escalade vers l’équipe IT).

Documentez les étapes nécessaires pour restaurer le service en cas de panne majeure.

Assurez-vous que toutes les parties prenantes connaissent le plan.

Outils recommandés

Logiciels de gestion des risques (ex. RiskWatch) pour centraliser l’analyse.

Plateformes de monitoring comme Prometheus ou Grafana pour surveiller l’état du système.

Services cloud avec haute disponibilité (ex. AWS RDS, Azure) pour réduire les risques liés à l’infrastructure.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’une liste exhaustive des risques techniques associés aux workflows automatisés.

D’une matrice claire permettant de prioriser les actions préventives.

D’un plan d’urgence documenté et prêt à être exécuté en cas d’incident.

II. Architecture de Production

1. Stratégie multi-environnements

Pour garantir la stabilité, la sécurité et la qualité des workflows automatisés sous n8n, il est essentiel de mettre en place une stratégie multi-environnements. Cette approche permet de séparer les différentes étapes du cycle de vie des workflows (développement, test, production) et d’assurer une transition fluide entre elles.

Objectifs de la stratégie

Isoler les environnements

Prévenir les interférences entre les workflows en cours de développement/test et ceux en production.

Faciliter les tests

Permettre une validation approfondie des workflows dans un environnement contrôlé avant leur mise en production.

Réduire les risques en production

Minimiser les erreurs dues à des modifications non testées ou à des conflits entre workflows.

Optimiser le déploiement continu

Mettre en place un pipeline structuré pour gérer les mises à jour et les déploiements.

Architecture recommandée

1. Environnement de développement (DEV)

Utilisé par les développeurs pour créer et modifier les workflows.

Peut être déployé localement ou sur un serveur dédié.

Inclut des données fictives ou anonymisées pour éviter tout risque lié aux données sensibles.

2. Environnement de test (TEST)

Permet de valider le bon fonctionnement des workflows dans des conditions proches de la production.

Utilise une base de données et des connecteurs similaires à ceux de l’environnement de production.

Inclut des outils pour simuler différents scénarios (ex. erreurs réseau, timeout).

3. Environnement de production (PROD)

Héberge les workflows opérationnels utilisés par l’entreprise.

Doit être optimisé pour la performance, la sécurité et la haute disponibilité.

Inclut un monitoring actif pour détecter rapidement les anomalies.

Meilleures pratiques

1. Séparation stricte des environnements

Utilisez des instances distinctes d’n8n pour chaque environnement.

Configurez des bases de données séparées pour éviter tout risque d’interférence.

2. Gestion des configurations

Centralisez les configurations spécifiques à chaque environnement dans des fichiers distincts ou via des variables d’environnement.

Utilisez un gestionnaire comme Docker Compose pour simplifier le déploiement multi-environnements.

3. Synchronisation contrôlée

Implémentez un processus structuré pour migrer les workflows d’un environnement à l’autre (ex. export/import JSON dans n8n).

Testez systématiquement chaque workflow dans l’environnement TEST avant son déploiement en PROD.

4. Automatisation du pipeline

Intégrez un pipeline CI/CD (ex. GitHub Actions, GitLab CI) pour automatiser le déploiement entre DEV, TEST et PROD.

Ajoutez des étapes de validation automatique (linting, tests unitaires) avant chaque mise en production.

Outils recommandés

Docker ou Kubernetes pour isoler et gérer vos environnements.

Plateformes CI/CD comme Jenkins, GitHub Actions ou GitLab CI/CD.

Gestionnaires secrets comme HashiCorp Vault ou AWS Secrets Manager pour sécuriser les configurations sensibles dans chaque environnement.

Résultat attendu

À la fin de cette étape, vous disposerez

D’une architecture multi-environnements bien définie et documentée.

D’un processus clair pour développer, tester et déployer vos workflows sans risque d’interruption en production.

D’une base solide pour intégrer un pipeline CI/CD dans vos opérations.

II. Architecture de Production

2. Configuration PostgreSQL optimisée

PostgreSQL est la base de données recommandée pour les déploiements en production d’n8n, car elle offre des performances élevées, une gestion avancée des transactions et une grande fiabilité. Une configuration optimisée de PostgreSQL est essentielle pour garantir la scalabilité et la stabilité des workflows automatisés, en particulier lorsque le volume de données ou le nombre d’exécutions augmente.

Objectifs de l’optimisation

Améliorer les performances

Réduire les temps d’exécution des requêtes et maximiser la vitesse d’accès aux données.

Assurer la fiabilité

Prévenir les pertes de données ou les corruptions en cas de panne.

Faciliter la scalabilité

Préparer la base de données à gérer une charge croissante sans dégradation des performances.

Renforcer la sécurité

Protéger les données sensibles stockées dans la base.

Étapes pour une configuration optimisée

1. Choix des ressources matérielles

Allouez suffisamment de ressources (CPU, RAM, stockage) à votre instance PostgreSQL.

Utilisez des disques SSD pour améliorer les performances d’écriture et de lecture.

Adaptez les ressources en fonction du volume attendu d’exécutions dans n8n.

2. Paramètres essentiels à ajuster Modifiez les paramètres par défaut de PostgreSQL pour mieux répondre aux besoins de production - `shared_buffers`

Allouez environ 25 % à 40 % de la RAM disponible au cache PostgreSQL.

- `work_mem`

Ajustez cette valeur pour optimiser les opérations complexes (tri, jointures).

- `maintenance_work_mem`

Augmentez cette valeur pour accélérer les tâches de maintenance (vacuum, analyse).

- `max_connections`

Définissez un nombre adapté en fonction du nombre attendu de connexions simultanées depuis n8n.

- `wal_level`

Configurez-le sur `replica` ou `logical` si vous prévoyez une réplication ou une sauvegarde continue.

- `checkpoint_timeout` et `max_wal_size`

Ajustez ces paramètres pour réduire la fréquence des checkpoints et améliorer les performances.

3. Indexation des tables critiques

Analysez les requêtes exécutées fréquemment par n8n (logs, exécutions, etc.).

Créez des index sur les colonnes utilisées dans les filtres ou les jointures pour accélérer ces requêtes.

Utilisez des index partiels ou multicolonnes si nécessaire.

4. Planification des tâches de maintenance

Activez l’autovacuum pour éviter l’accumulation de tuples morts et maintenir les performances.

Planifiez régulièrement des tâches `VACUUM FULL` et `ANALYZE` pour optimiser l’utilisation du stockage et mettre à jour les statistiques.

5. Sauvegardes et réplication

Configurez des sauvegardes régulières avec un outil comme `pg_dump`, `pgBackRest`, ou un service cloud.

Activez la réplication (streaming replication) pour garantir une haute disponibilité en cas de panne.

6. Sécurisation de l’accès

Activez SSL/TLS pour sécuriser les connexions entre n8n et PostgreSQL.

Restreignez l’accès via le fichier `pg_hba.conf`, en autorisant uniquement les IP nécessaires.

Utilisez un gestionnaire comme HashiCorp Vault pour stocker et gérer les identifiants d’accès.

Outils recommandés

Outils d’analyse comme `pg_stat_statements` pour surveiller et optimiser les requêtes lentes.

PgTune ( pour générer une configuration adaptée à vos ressources matérielles.

Outils de monitoring comme pgAdmin, Zabbix ou Grafana avec un plugin PostgreSQL.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’une instance PostgreSQL configurée spécifiquement pour supporter vos workflows n8n en production.

D’une base optimisée pour gérer efficacement une charge importante tout en garantissant la sécurité et la fiabilité des données.

D’un plan clair pour effectuer des sauvegardes régulières et assurer une haute disponibilité.

II. Architecture de Production

3. Intégration Redis pour le scaling

Redis est un système de gestion de cache et de file d’attente en mémoire très performant, idéal pour améliorer la scalabilité des workflows automatisés sous n8n. Lorsqu’un grand nombre d’exécutions simultanées est attendu, l’intégration de Redis permet de mieux gérer les files d’attente et d’accélérer les processus, tout en réduisant la charge sur la base de données principale.

Objectifs de l’intégration

Optimiser la gestion des files d’attente

Redis permet de gérer efficacement les tâches en attente et les exécutions programmées dans n8n.

Réduire la charge sur PostgreSQL

En déplaçant certaines opérations temporaires vers Redis, vous diminuez la sollicitation de votre base de données.

Améliorer les performances globales

Redis accélère le traitement des workflows en fournissant un accès rapide aux données en mémoire.

Faciliter le scaling horizontal

Redis permet à plusieurs instances d’n8n de partager une file d’attente commune, ce qui est essentiel pour les architectures distribuées.

Étapes pour intégrer Redis avec n8n

1. Installation et configuration de Redis

Installez Redis sur un serveur dédié ou utilisez un service managé comme AWS ElastiCache ou Azure Cache for Redis.

Configurez Redis pour accepter uniquement les connexions sécurisées (SSL/TLS) et limitez l’accès aux IP autorisées.

Ajustez les paramètres clés comme `maxmemory` et `maxmemory-policy` pour optimiser l’utilisation des ressources.

2. Connexion d’n8n à Redis

Modifiez le fichier de configuration d’n8n (`.env`) pour activer l’utilisation de Redis

```env

N8N_QUEUE_BULL_REDIS_HOST=

N8N_QUEUE_BULL_REDIS_PORT=

N8N_QUEUE_BULL_REDIS_PASSWORD=

```

Redémarrez votre instance n8n pour appliquer les changements.

3. Configuration des workflows avec files d’attente

Activez le mode file d’attente dans n8n pour que les exécutions soient gérées par Redis.

Vérifiez que les workflows critiques ou gourmands en ressources utilisent ce mode afin d’éviter les blocages.

4. Monitoring et optimisation

Surveillez l’utilisation de Redis avec des outils comme `redis-cli`, Grafana (avec un plugin Redis), ou un service managé.

Analysez les métriques clés telles que la latence, le nombre de connexions simultanées, et l’utilisation mémoire.

Ajustez la configuration selon vos besoins (ex. augmenter `maxmemory` si la file d’attente devient trop grande).

5. Scaling horizontal avec Redis

Déployez plusieurs instances d’n8n connectées à une même instance Redis pour répartir la charge.

Assurez-vous que chaque instance utilise une configuration identique pour éviter des conflits dans la file d’attente.

Meilleures pratiques

Utilisez une version récente et stable de Redis pour bénéficier des dernières optimisations.

Implémentez une stratégie de sauvegarde régulière des données Redis si elles sont critiques (ex. snapshots).

Configurez une réplication Redis ou un cluster Redis pour assurer une haute disponibilité.

Outils recommandés

Outils natifs comme `redis-cli` pour gérer et surveiller votre instance Redis.

Plateformes avancées comme Grafana ou Datadog pour visualiser les métriques en temps réel.

Services managés (AWS ElastiCache, Google Cloud Memorystore) pour simplifier la gestion et bénéficier d’une haute disponibilité.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’une intégration fonctionnelle entre n8n et Redis, permettant une gestion efficace des files d’attente.

D’un système prêt à supporter un grand volume d’exécutions simultanées grâce au scaling horizontal.

D’une architecture robuste et performante adaptée aux besoins croissants de votre entreprise.

II. Architecture de Production

4. Sauvegardes automatisées

La mise en place d’un système de sauvegardes automatisées est indispensable pour garantir la pérennité des workflows n8n en production. En cas de panne, de corruption des données ou d’erreur humaine, les sauvegardes permettent de restaurer rapidement l’état du système et de minimiser les interruptions.

Objectifs des sauvegardes automatisées

Prévenir la perte de données

Assurer une récupération rapide des données critiques (workflows, configurations, bases de données).

Faciliter la restauration

Simplifier la procédure de récupération en cas d’incident.

Garantir la conformité

Répondre aux exigences légales ou réglementaires en matière de conservation des données.

Assurer la continuité du service

Minimiser les interruptions en cas de problème majeur.

Étapes pour mettre en place les sauvegardes automatisées

1. Identification des éléments à sauvegarder

Base de données PostgreSQL contenant les workflows, exécutions et configurations.

Fichiers de configuration n8n (ex. `.env`).

Secrets et identifiants stockés dans un gestionnaire externe (ex. HashiCorp Vault).

Journaux et logs importants pour le diagnostic.

2. Choix de la stratégie de sauvegarde

Sauvegarde complète

Capture l’intégralité des données et fichiers nécessaires à la restauration complète du système.

Sauvegarde incrémentale

Enregistre uniquement les modifications depuis la dernière sauvegarde complète, réduisant ainsi l’espace requis.

Sauvegarde différentielle

Sauvegarde les modifications depuis la dernière sauvegarde complète, mais conserve plus d’informations que l’incrémentale.

3. Automatisation des sauvegardes PostgreSQL

Utilisez `pg_dump` pour effectuer des sauvegardes complètes

```bash

pg_dump -U -h -d > sauvegarde.sql

```

Planifiez cette commande via `cron` ou un outil comme `systemd` pour une exécution régulière (ex. toutes les nuits).

Si vous utilisez un service managé comme AWS RDS, configurez les snapshots automatiques via l’interface cloud.

4. Stockage sécurisé des sauvegardes

Enregistrez les fichiers de sauvegarde sur un stockage distant sécurisé (ex. AWS S3, Google Cloud Storage).

Activez le chiffrement des fichiers avant leur transfert pour protéger les données sensibles.

Configurez une rotation des sauvegardes pour supprimer automatiquement les anciennes versions et éviter une surcharge du stockage.

5. Test régulier des restaurations

Effectuez périodiquement des tests pour vérifier que les sauvegardes sont exploitables.

Simulez une restauration complète dans un environnement isolé pour valider le processus.

6. Monitoring et alertes

Surveillez l’état des sauvegardes avec un outil comme Prometheus ou Grafana.

Configurez des alertes en cas d’échec d’une tâche de sauvegarde.

Meilleures pratiques

Planifiez les sauvegardes pendant les heures creuses pour minimiser l’impact sur les performances du système.

Conservez plusieurs copies des sauvegardes dans différents emplacements géographiques pour réduire le risque lié aux catastrophes locales.

Documentez clairement le processus de restauration et formez l’équipe IT à l’exécuter rapidement.

Outils recommandés

- `pg_dump` et `pg_restore` pour gérer les sauvegardes PostgreSQL.

Services cloud comme AWS S3 ou Azure Blob Storage pour le stockage sécurisé.

Outils d’automatisation comme Ansible ou Terraform pour configurer et gérer les tâches de sauvegarde.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un système de sauvegarde automatisé fiable et sécurisé couvrant tous les éléments critiques d’n8n.

D’une procédure documentée permettant une restauration rapide en cas d’incident.

D’une architecture conforme aux meilleures pratiques en matière de protection des données.

III. Sécurité Industrielle

1. Hardening des instances Docker

Dans un environnement de production, n8n est souvent déployé via Docker pour sa simplicité et sa portabilité. Cependant, une configuration par défaut de Docker peut exposer votre système à des risques de sécurité. Le hardening des instances Docker vise à renforcer leur sécurité afin de protéger les workflows automatisés et les données sensibles contre les attaques ou les erreurs.

Objectifs du hardening

Réduire la surface d’attaque

Limiter les vecteurs d’exploitation en sécurisant les configurations.

Protéger les données sensibles

Empêcher tout accès non autorisé aux données manipulées par n8n.

Assurer la conformité

Respecter les normes de sécurité et réglementations (ex. RGPD).

Renforcer la résilience

Prévenir les interruptions de service dues à des attaques ou des erreurs.

Étapes pour sécuriser les instances Docker

1. Utiliser des images Docker fiables

Téléchargez uniquement l’image officielle n8n depuis Docker Hub ou une source vérifiée.

Vérifiez régulièrement que l’image est à jour et appliquez les mises à jour de sécurité.

Si nécessaire, créez une image personnalisée en partant d’une base minimale (ex. `alpine`) pour réduire la taille et les dépendances.

2. Limiter les privilèges du conteneur

Exécutez n8n avec un utilisateur non-root dans le conteneur.

Ajoutez cette ligne dans votre `Dockerfile` ou configuration

```dockerfile

USER node

```

Utilisez l’option `--cap-drop ALL` pour désactiver toutes les capacités inutiles du conteneur.

3. Configurer les réseaux Docker avec précaution

Utilisez un réseau Docker dédié pour isoler n8n des autres conteneurs.

```bash

docker network create n8n_network

docker run --network n8n_network ...

```

Évitez d’exposer directement le port du conteneur sur Internet (utilisez un proxy inversé comme Nginx).

4. Stocker les secrets en toute sécurité

Ne stockez jamais vos secrets ou identifiants directement dans le fichier `Dockerfile`.

Utilisez des gestionnaires de secrets comme HashiCorp Vault ou AWS Secrets Manager pour injecter dynamiquement les variables sensibles dans le conteneur.

5. Activer le chiffrement des communications

Configurez SSL/TLS via un proxy inversé comme Nginx ou Traefik pour sécuriser les connexions HTTP entre n8n et ses utilisateurs.

Utilisez des certificats valides générés par Let’s Encrypt ou une autorité reconnue.

6. Surveiller et limiter l’utilisation des ressources

Configurez des limites strictes sur l’utilisation CPU et mémoire du conteneur pour éviter qu’il ne monopolise les ressources en cas de surcharge.

```bash

docker run --memory="512m" --cpus="1" ...

```

7. Mettre en place un monitoring actif

Intégrez des outils comme Prometheus ou Datadog pour surveiller l’état du conteneur (ressources, logs, etc.).

Configurez des alertes en cas d’activité suspecte ou de dépassement des limites configurées.

Meilleures pratiques

Mettez à jour régulièrement Docker et vos images pour bénéficier des derniers correctifs de sécurité.

Utilisez SELinux ou AppArmor pour renforcer l’isolation entre conteneurs.

Activez la journalisation complète des activités du conteneur pour faciliter le diagnostic en cas d’incident.

Outils recommandés

Docker Bench for Security

Un outil qui analyse votre configuration Docker et propose des recommandations de sécurité.

Proxy inversé comme Nginx ou Traefik pour gérer SSL/TLS et limiter l’exposition réseau.

Gestionnaires secrets comme HashiCorp Vault, AWS Secrets Manager, ou Kubernetes Secrets.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’instances Docker sécurisées et conformes aux meilleures pratiques de hardening.

D’un environnement isolé et protégé contre les accès non autorisés ou malveillants.

D’une base solide pour garantir la sécurité opérationnelle de vos workflows n8n en production.

III. Sécurité Industrielle

2. Gestion des secrets professionnelle

La gestion des secrets est une composante essentielle de la sécurité dans un environnement de production. Les secrets incluent des informations sensibles comme les identifiants de connexion, les clés API, les certificats SSL/TLS ou encore les mots de passe. Une mauvaise gestion de ces informations peut entraîner des fuites de données ou des accès non autorisés à vos workflows n8n.

Objectifs d’une gestion professionnelle des secrets

Protéger les informations sensibles

Empêcher leur exposition accidentelle ou malveillante.

Centraliser et contrôler l’accès

Gérer les secrets de manière centralisée pour simplifier leur utilisation et leur rotation.

Automatiser la distribution sécurisée

Éviter leur inclusion directe dans le code ou les fichiers de configuration.

Respecter les normes de sécurité

Répondre aux exigences réglementaires et aux meilleures pratiques.

Étapes pour une gestion efficace des secrets

1. Identification des secrets nécessaires

Listez tous les secrets utilisés par vos workflows n8n, comme

Les identifiants pour accéder aux bases de données (PostgreSQL).

Les clés API pour les services externes (ex. Slack, Google Sheets).

Les certificats SSL/TLS pour sécuriser les communications.

Classez-les par niveau de sensibilité pour prioriser leur protection.

2. Utilisation d’un gestionnaire de secrets

Adoptez un outil dédié pour stocker et gérer vos secrets en toute sécurité, comme

HashiCorp Vault

Solution open-source robuste pour la gestion centralisée des secrets.

AWS Secrets Manager ou Azure Key Vault

Services cloud intégrés à leurs écosystèmes respectifs.

Docker Secrets

Pour une utilisation simple dans un environnement Docker.

Configurez le gestionnaire pour limiter l’accès aux utilisateurs et services autorisés uniquement.

3. Injection dynamique des secrets

Configurez votre environnement n8n pour récupérer dynamiquement les secrets depuis le gestionnaire au moment du démarrage.

Exemple avec Docker et Docker Secrets 1. Stockez un secret dans Docker

```bash

echo "mot_de_passe_postgresql" | docker secret create postgres_password -

```

2. Modifiez votre fichier `docker-compose.yml`

```yaml

services:

n8n:

image: n8nio/n8n

secrets:

postgres_password

secrets:

postgres_password:

external: true

```

Évitez d’inclure directement les secrets dans le fichier `.env` ou dans le code source.

4. Rotation régulière des secrets

Planifiez une rotation périodique (ex. tous les 90 jours) pour réduire l’impact d’une éventuelle compromission.

Automatisez cette rotation avec votre gestionnaire de secrets et mettez à jour automatiquement les workflows concernés.

5. Audit et surveillance des accès

Activez la journalisation dans votre gestionnaire de secrets pour suivre toutes les actions (lecture, écriture, suppression).

Analysez régulièrement ces journaux pour détecter toute activité suspecte.

6. Chiffrement des données sensibles

Assurez-vous que tous les secrets sont chiffrés au repos (dans le stockage) et en transit (lorsqu’ils sont transmis à n8n).

Utilisez des algorithmes modernes comme AES-256 pour le chiffrement au repos.

Meilleures pratiques

Respectez le principe du moindre privilège

chaque workflow ou utilisateur ne doit avoir accès qu’aux secrets dont il a strictement besoin.

Ne partagez jamais vos secrets via des canaux non sécurisés (email, messagerie instantanée).

Intégrez un processus d’urgence pour révoquer immédiatement un secret compromis.

Outils recommandés

HashiCorp Vault

Gestion centralisée avec support avancé pour la rotation et l’audit.

AWS Secrets Manager, Azure Key Vault, ou Google Secret Manager

Solutions cloud natives.

Docker Secrets

Solution simple pour les environnements Docker uniquement.

Outils CI/CD comme Jenkins ou GitHub Actions avec intégration à un gestionnaire de secrets.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un système sécurisé et centralisé pour gérer tous vos secrets liés à n8n.

D’une méthode automatisée pour injecter ces informations sensibles sans risque d’exposition.

D’un processus clair pour surveiller, auditer et faire évoluer vos pratiques en matière de gestion des secrets.

III. Sécurité Industrielle

3. Audit de conformité RGPD

La mise en production d’applications développées sous n8n implique souvent le traitement de données personnelles. En tant que tel, il est essentiel de garantir la conformité avec le Règlement Général sur la Protection des Données (RGPD) pour protéger les droits des utilisateurs et éviter les sanctions légales. Un audit de conformité RGPD permet d’identifier les risques liés au traitement des données personnelles et de mettre en place les mesures nécessaires pour respecter les exigences réglementaires.

Objectifs de l’audit RGPD

Identifier les données personnelles traitées

Cartographier toutes les informations sensibles manipulées par les workflows n8n.

Évaluer les risques

Analyser les points faibles susceptibles d’entraîner une violation des données.

Mettre en place des mesures correctives

Adapter les workflows et l’infrastructure pour respecter les principes du RGPD.

Documenter la conformité

Produire des preuves démontrant que votre système respecte le RGPD.

Étapes pour réaliser un audit RGPD

1. Cartographie des données personnelles

Identifiez toutes les données personnelles traitées par vos workflows (ex. noms, adresses email, numéros de téléphone).

Documentez leur origine (collecte via API, bases de données internes) et leur destination (services tiers, stockage).

Classez ces données selon leur sensibilité.

2. Analyse des workflows n8n

Examinez chaque workflow pour identifier les étapes où des données personnelles sont manipulées.

Vérifiez que seuls les workflows nécessaires accèdent à ces informations (principe de minimisation).

Assurez-vous que toutes les actions sur ces données sont justifiées par une base légale (ex. consentement explicite, contrat).

3. Évaluation des risques

Analysez les risques liés à la sécurité des données personnelles dans votre infrastructure

Accès non autorisé aux bases de données PostgreSQL.

Fuite d’informations via des connecteurs tiers mal sécurisés.

Stockage non chiffré ou exposition accidentelle via Docker.

Utilisez une matrice de risque pour prioriser les actions correctives.

4. Mise en œuvre des mesures correctives

Chiffrement des données sensibles

Activez le chiffrement au repos (dans PostgreSQL) et en transit (via SSL/TLS).

Anonymisation ou pseudonymisation

Remplacez certaines informations personnelles par des identifiants anonymes lorsque cela est possible.

Gestion des accès

Limitez l’accès aux workflows contenant des données personnelles aux utilisateurs autorisés uniquement.

Journalisation et suivi

Configurez n8n pour enregistrer toutes les actions sur les données personnelles (lecture, modification, suppression).

5. Documentation et preuves de conformité

Créez un registre des traitements décrivant chaque workflow manipulant des données personnelles, conformément à l’article 30 du RGPD.

Documentez vos politiques de sécurité et vos procédures en cas d’incident (ex. notification dans les 72 heures).

Produisez un rapport d’audit détaillé indiquant les mesures prises pour garantir la conformité.

6. Formation et sensibilisation

Formez vos équipes techniques et opérationnelles aux principes du RGPD.

Sensibilisez-les aux bonnes pratiques en matière de protection des données.

Meilleures pratiques

Implémentez un processus régulier d’audit RGPD pour suivre l’évolution des workflows et garantir leur conformité continue.

Testez régulièrement vos procédures en cas d’incident (ex. simulation d’une fuite de données).

Collaborez avec un Délégué à la Protection des Données (DPO) si votre organisation en dispose.

Outils recommandés

Plateformes spécialisées comme OneTrust ou DataGuard pour gérer vos audits RGPD.

Outils de monitoring comme Grafana ou Datadog pour surveiller l’accès aux données sensibles dans n8n.

Services cloud conformes au RGPD (ex. AWS Europe, Azure France) pour héberger vos bases de données.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’une cartographie complète et documentée des traitements de données personnelles réalisés par vos workflows n8n.

D’une infrastructure adaptée aux exigences du RGPD, avec une gestion sécurisée et transparente des informations sensibles.

D’un registre et d’un rapport d’audit prouvant votre conformité réglementaire.

IV. Déploiement Continu

1. Intégration GitOps avancée

Le modèle GitOps est une approche moderne et efficace pour gérer les déploiements d’applications, y compris celles développées sous n8n. Il repose sur l’utilisation de Git comme source unique de vérité pour les configurations et les workflows, permettant une automatisation complète des déploiements et une gestion simplifiée des versions.

Objectifs de l’intégration GitOps

Automatiser les déploiements

Simplifier et accélérer la mise à jour des workflows en production.

Garantir la cohérence

Assurer que les environnements (DEV, TEST, PROD) sont alignés avec les configurations définies dans Git.

Faciliter le versioning

Suivre l’historique des modifications apportées aux workflows et configurations.

Renforcer la sécurité

Limiter les interventions manuelles et centraliser les changements dans un système contrôlé.

Étapes pour mettre en place GitOps avec n8n

1. Centralisation des configurations dans Git

Exportez vos workflows n8n au format JSON et stockez-les dans un dépôt Git dédié.

Ajoutez également vos fichiers de configuration (ex. `.env`, `docker-compose.yml`) au dépôt.

Organisez le dépôt selon les environnements (ex. dossiers `dev`, `test`, `prod`).

2. Automatisation des déploiements via un outil GitOps

Utilisez des outils GitOps comme ArgoCD ou Flux pour surveiller votre dépôt Git et appliquer automatiquement les changements.

Configurez ces outils pour synchroniser les workflows et configurations avec vos instances n8n

Exemple avec ArgoCD

```yaml

apiVersion: argoproj.io/v1alpha1

kind: Application

metadata:

name: n8n-app

spec:

source:

repoURL: '

targetRevision: HEAD

path: prod

destination:

server: '

namespace: n8n

syncPolicy:

automated:

prune: true

selfHeal: true

```

3. Gestion des workflows comme du code

Adoptez une approche "Workflow-as-Code" où chaque modification de workflow est effectuée via un commit dans le dépôt Git.

Utilisez des branches pour gérer les modifications avant leur mise en production (ex. `feature/new-workflow`, `hotfix/security-update`).

Implémentez des pull requests (PR) pour valider les changements avant leur fusion dans la branche principale.

4. Pipeline CI/CD intégré

Configurez un pipeline CI/CD (ex. GitHub Actions, GitLab CI) pour automatiser les tests et validations avant le déploiement.

Exemple de pipeline avec GitHub Actions

```yaml

name: Deploy n8n Workflows

on:

push:

branches:

main

jobs:

test:

runs-on: ubuntu-latest

steps:

name: Checkout code

uses: actions/checkout@v2

name: Validate JSON files

run: jq . workflows/*.json

deploy:

needs: test

runs-on: ubuntu-latest

steps:

name: Deploy to production

run: kubectl apply -f workflows/prod/

```

5. Monitoring et rollback automatisé

Configurez votre outil GitOps pour détecter automatiquement les erreurs après un déploiement (ex. échec d’un workflow).

Implémentez une stratégie de rollback automatique en cas de problème, en revenant à la dernière version stable dans Git.

Meilleures pratiques

Utilisez des tags ou des versions dans votre dépôt Git pour identifier clairement chaque déploiement.

Effectuez des tests approfondis dans l’environnement TEST avant de fusionner les modifications dans la branche PROD.

Documentez clairement le processus GitOps pour faciliter son adoption par l’équipe.

Outils recommandés

ArgoCD ou Flux pour la gestion GitOps.

Plateformes CI/CD comme Jenkins, GitHub Actions ou GitLab CI/CD.

Outils de validation JSON comme `jq` pour vérifier la syntaxe des workflows avant leur déploiement.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un système automatisé basé sur GitOps pour gérer vos déploiements n8n en toute sécurité.

D’une méthode robuste pour versionner, tester et déployer vos workflows sans intervention manuelle.

D’une architecture alignée avec les meilleures pratiques DevOps modernes.

IV. Déploiement Continu

2. Pipeline CI/CD avec checks

Un pipeline CI/CD bien conçu permet d’automatiser les étapes clés du développement, des tests et du déploiement des workflows n8n. L’ajout de checks (vérifications automatisées) garantit que seules les modifications validées, sécurisées et conformes passent en production, réduisant ainsi les risques d’erreurs ou de vulnérabilités.

Objectifs d’un pipeline CI/CD avec checks

Automatiser les tests

Vérifier systématiquement que les workflows n8n fonctionnent comme prévu.

Assurer la qualité

Détecter les erreurs ou les régressions avant le déploiement.

Renforcer la sécurité

Identifier les vulnérabilités potentielles dans le code ou la configuration.

Accélérer les déploiements

Réduire le temps nécessaire pour passer des modifications au déploiement en production.

Étapes pour configurer un pipeline CI/CD avec checks

1. Définir les étapes du pipeline

Étape 1

Intégration continue (CI)

Valider la syntaxe des workflows JSON (ex. via `jq`).

Exécuter des tests unitaires ou fonctionnels sur des workflows critiques.

Analyser le code pour détecter les vulnérabilités (ex. analyse statique avec SonarQube).

Étape 2

Déploiement continu (CD)

Déployer automatiquement les workflows validés dans l’environnement TEST.

Effectuer des tests end-to-end (E2E) dans cet environnement.

Si tous les tests passent, déclencher le déploiement vers PROD.

2. Configurer un pipeline dans GitHub Actions (exemple) Voici un exemple de configuration pour un pipeline CI/CD avec checks dans GitHub Actions

```yaml

name: CI/CD Pipeline for n8n

on:

push:

branches:

main

jobs:

validate:

runs-on: ubuntu-latest

steps:

name: Checkout code

uses: actions/checkout@v2

name: Validate workflow JSON files

run: |

for file in workflows/*.json; do

jq . "$file" > /dev/null || exit 1

done

name: Static code analysis

uses: sonarsource/sonarcloud-github-action@v1

with:

projectKey: your_project_key organization: your_organization deploy-test: needs: validate runs-on: ubuntu-latest steps:

name: Deploy to TEST environment

run: ./deploy.sh test deploy-prod: needs: deploy-test if: success() runs-on: ubuntu-latest steps:

name: Deploy to PROD environment

run: ./deploy.sh prod

```

3. Ajouter des checks spécifiques à n8n

Vérifiez que tous les connecteurs utilisés dans vos workflows sont disponibles et configurés correctement.

Testez les performances des workflows pour éviter qu’ils ne surchargent l’infrastructure.

Implémentez des tests de sécurité pour détecter toute fuite de secrets ou d’informations sensibles.

4. Intégrer des approbations manuelles pour les étapes critiques

Ajoutez une étape d’approbation manuelle avant le déploiement en production, notamment pour des workflows sensibles.

Exemple avec GitLab CI/CD

```yaml

stages:

validate

deploy

deploy-prod: stage: deploy script:

./deploy.sh prod

when: manual

```

5. Surveiller et auditer le pipeline

Activez la journalisation complète pour suivre l’exécution de chaque étape du pipeline.

Configurez des alertes en cas d’échec ou d’anomalie (ex. via Slack ou email).

Meilleures pratiques

Exécutez vos pipelines dans un environnement isolé (ex. conteneurs Docker) pour éviter tout impact sur la production.

Limitez l’accès aux secrets et artefacts générés pendant le pipeline aux étapes qui en ont besoin.

Testez régulièrement vos pipelines pour vous assurer qu’ils fonctionnent correctement même après des mises à jour.

Outils recommandés

GitHub Actions, GitLab CI/CD, TravisCI ou CircleCI pour configurer et exécuter vos pipelines.

SonarQube ou Snyk pour l’analyse statique et la détection de vulnérabilités.

OpenTelemetry ou New Relic pour surveiller et observer vos pipelines.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un pipeline CI/CD robuste et automatisé, intégrant des checks à chaque étape clé.

D’une méthode fiable pour détecter et corriger les erreurs avant qu’elles n’atteignent la production.

D’un processus accéléré et sécurisé pour livrer vos workflows n8n en production.

IV. Déploiement Continu

3. Stratégie Blue/Green

La stratégie de déploiement Blue/Green est une approche avancée qui permet de minimiser les interruptions de service et les risques lors des mises à jour en production. Elle repose sur l’utilisation de deux environnements distincts (Blue et Green)

l’un représente la version actuelle en production, tandis que l’autre est utilisé pour déployer et tester la nouvelle version avant de basculer le trafic.

Objectifs de la stratégie Blue/Green

Réduire les interruptions

Garantir une continuité de service pendant les mises à jour.

Faciliter les tests en production

Permettre de valider la nouvelle version dans un environnement identique à celui en production.

Simplifier les rollbacks

Revenir rapidement à l’ancienne version en cas de problème.

Améliorer la sécurité

Tester les workflows et configurations sans impacter directement les utilisateurs finaux.

Étapes pour mettre en œuvre une stratégie Blue/Green avec n8n

1. Configurer deux environnements distincts

Créez deux instances séparées d’n8n (Blue et Green) avec des configurations identiques (bases de données, connecteurs, etc.).

Utilisez un proxy inversé (ex. Nginx, Traefik) ou un load balancer pour gérer le routage du trafic entre ces environnements.

2. Déployer la nouvelle version dans l’environnement Green

Effectuez le déploiement des nouveaux workflows ou configurations dans l’environnement Green.

Testez la nouvelle version dans cet environnement pour valider son bon fonctionnement (tests fonctionnels, performance, sécurité).

3. Basculer le trafic vers l’environnement Green

Une fois les tests validés, modifiez le routage du trafic utilisateur pour qu’il pointe vers l’environnement Green.

Exemple avec Nginx

```nginx

upstream n8n {

server green.example.com;

# server blue.example.com; # Commenté pour basculer vers Green

}

```

Surveillez attentivement la performance et le comportement des workflows après la bascule.

4. Conserver l’environnement Blue comme fallback

Ne supprimez pas immédiatement l’environnement Blue après la bascule.

En cas de problème détecté dans Green, revenez rapidement à Blue en modifiant à nouveau le routage du trafic.

5. Synchroniser les environnements après validation

Une fois que la nouvelle version est stable et validée, mettez à jour l’environnement Blue pour qu’il reflète l’état actuel de Green.

Préparez Blue pour accueillir le prochain déploiement.

Meilleures pratiques

Automatiser le processus de déploiement et de bascule avec des outils comme Terraform ou Ansible.

Effectuer des tests A/B avant de basculer 100 % du trafic vers Green (ex. diriger 10 % du trafic vers Green pour valider son comportement).

Documenter clairement les étapes nécessaires pour effectuer un rollback rapide en cas d’échec.

Outils recommandés

Proxy inversé

Nginx, Traefik ou HAProxy pour gérer le routage entre Blue et Green.

Plateformes cloud avec support natif pour Blue/Green (ex. AWS Elastic Beanstalk).

Outils d’automatisation comme Terraform ou Kubernetes (avec des déploiements Canary ou Rolling Update).

Résultat attendu

À l’issue de cette étape, vous disposerez

D’une architecture Blue/Green fonctionnelle permettant des mises à jour sans interruption.

D’une méthode fiable pour tester et valider vos workflows avant leur mise en production complète.

D’un mécanisme rapide pour effectuer un rollback en cas de problème.

V. Monitoring de Prod

1. Centralisation des logs

La centralisation des logs est une étape essentielle pour surveiller et diagnostiquer efficacement les workflows n8n en production. Elle permet de regrouper toutes les informations dans un emplacement unique, facilitant ainsi l’analyse des performances, la détection des anomalies et la résolution rapide des problèmes.

Objectifs de la centralisation des logs

Faciliter le diagnostic

Accéder rapidement aux informations pertinentes pour identifier les erreurs ou les ralentissements.

Améliorer la visibilité

Regrouper les logs provenant de différentes instances ou environnements (DEV, TEST, PROD).

Renforcer la sécurité

Prévenir la perte ou l’altération des logs grâce à une gestion centralisée.

Automatiser les alertes

Détecter automatiquement les anomalies et envoyer des notifications aux équipes concernées.

Étapes pour centraliser les logs n8n

1. Configurer les options de log dans n8n

Définissez le niveau de log approprié selon vos besoins (ex. `info` pour une vue générale ou `debug` pour un suivi détaillé).

Exemple de configuration via environnement

```env

N8N_LOG_LEVEL=info

N8N_LOG_OUTPUT=file

N8N_LOG_FILE_LOCATION=/var/log/n8n/n8n.log

N8N_LOG_FILE_SIZE_MAX=16

N8N_LOG_FILE_COUNT_MAX=100

```

2. Utiliser un système de gestion centralisée

Intégrez vos logs à une solution comme

ELK Stack (Elasticsearch, Logstash, Kibana)

Pour collecter, analyser et visualiser vos logs.

Graylog

Une alternative légère et performante pour gérer les journaux.

Splunk

Solution avancée pour les entreprises nécessitant une analyse approfondie.

Configurez n8n pour envoyer ses logs directement à ces outils via un agent ou un pipeline.

3. Activer le streaming des logs (Enterprise)

Si vous utilisez n8n Self-hosted Enterprise, configurez le streaming des logs pour les transmettre en temps réel à votre solution d’observation.

Exemple avec Logstash

```logstash

input {

file {

path => "/var/log/n8n/n8n.log"

start_position => "beginning"

}

}

output { elasticsearch { hosts => [" index => "n8n-logs" } }

```

4. Configurer des alertes automatisées

Définissez des règles dans votre outil de gestion (ex. Kibana) pour détecter les anomalies spécifiques aux workflows n8n (ex. erreurs fréquentes sur un connecteur).

Envoyez des notifications par email, SMS ou Slack lorsque ces règles sont déclenchées.

5. Analyser et optimiser régulièrement

Examinez périodiquement les logs pour identifier les tendances ou problèmes récurrents.

Utilisez ces informations pour optimiser vos workflows et configurations.

Meilleures pratiques

Conservez vos logs pendant une durée suffisante (ex. 90 jours) pour faciliter l’analyse historique.

Sécurisez l’accès aux journaux en limitant leur consultation aux utilisateurs autorisés uniquement.

Implémentez un système de rotation des fichiers log pour éviter qu’ils ne saturent le stockage.

Outils recommandés

ELK Stack (Elasticsearch, Logstash, Kibana) pour une solution complète.

Graylog ou Fluentd pour une gestion légère et flexible.

Prometheus avec Grafana pour surveiller les métriques en complément des journaux.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un système centralisé regroupant tous les journaux liés à vos workflows n8n.

D’une méthode efficace pour analyser, surveiller et diagnostiquer votre environnement de production.

D’un mécanisme automatisé d’alertes permettant une réponse rapide aux incidents.

V. Monitoring de Prod

2. Métriques clés à surveiller

Le suivi des métriques clés est essentiel pour évaluer la santé, les performances et la sécurité de vos workflows n8n en production. Ces indicateurs permettent d’identifier rapidement les anomalies, d’optimiser les ressources et de garantir une expérience utilisateur fluide.

Objectifs du suivi des métriques

Évaluer les performances

Mesurer l’efficacité des workflows et identifier les goulots d’étranglement.

Garantir la qualité des données

S’assurer que les workflows traitent correctement les informations sans erreurs ou pertes.

Renforcer la sécurité

Détecter les activités suspectes ou non autorisées.

Anticiper les problèmes

Identifier les tendances avant qu’elles n’affectent la production.

Métriques essentielles à surveiller

1. Métriques de performance

Latence des workflows

Temps moyen nécessaire pour exécuter un workflow.

Débit (Throughput)

Nombre d’exécutions de workflows par seconde ou par minute.

Taux d’erreur

Pourcentage de workflows échoués par rapport au total exécuté.

Temps de réponse des connecteurs

Latence des appels aux API externes utilisées dans les workflows.

2. Métriques d’utilisation

Nombre d’exécutions actives

Workflows en cours ou en attente dans la file d’attente.

Utilisation des ressources système

CPU et mémoire consommés par n8n.

Utilisation du disque pour le stockage temporaire ou permanent.

Charge sur Redis et PostgreSQL

Nombre de connexions simultanées et latence des requêtes.

3. Métriques de qualité des données

Taux de données invalides

Proportion de données rejetées ou incorrectes dans un workflow.

Complétude des données

Vérification des champs obligatoires dans les entrées traitées par les workflows.

4. Métriques de sécurité

Tentatives d’accès non autorisées

Activités suspectes sur l’interface ou l’API n8n.

Intégrité des secrets et identifiants

Surveillance des accès aux secrets utilisés dans les workflows.

Conformité RGPD

Vérification que les données personnelles sont correctement anonymisées ou supprimées selon les règles définies.

5. Métriques spécifiques aux files d’attente (Redis)

Longueur moyenne et maximale de la file d’attente.

Temps moyen passé par une tâche dans la file avant exécution.

Mise en œuvre avec Prometheus et Grafana

1. Activer l’exportation des métriques dans n8n

Configurez l’environnement pour activer le point d’accès `/metrics`

```env

N8N_METRICS=true

N8N_METRICS_INCLUDE_QUEUE_METRICS=true

```

Ajustez l’intervalle de mise à jour avec `N8N_METRICS_QUEUE_METRICS_INTERVAL`.

2. Configurer Prometheus pour collecter les métriques Ajoutez une configuration pour collecter les métriques exposées par n8n

```yaml

scrape_configs:

job_name: 'n8n'

static_configs:

targets: ['localhost:5678'] # Remplacez par l’adresse du service n8n

```

3. Créer des tableaux de bord Grafana

Intégrez Prometheus comme source de données dans Grafana.

Créez des graphiques pour visualiser chaque métrique clé (latence, taux d’erreur, etc.).

Configurez des alertes basées sur des seuils prédéfinis (ex. taux d’erreur > 5 %).

Meilleures pratiques

Fixez des seuils S.M.A.R.T (Spécifiques, Mesurables, Atteignables, Réalistes, Temporels) pour chaque métrique afin de détecter rapidement les anomalies.

Analysez régulièrement vos métriques en contexte (modifications récentes, incidents passés) pour mieux comprendre leur évolution.

Documentez vos processus de monitoring pour assurer leur pérennité et faciliter leur maintenance.

Outils recommandés

Prometheus pour collecter et stocker les métriques.

Grafana pour visualiser et analyser les données en temps réel.

New Relic ou Datadog pour un monitoring avancé incluant alertes et diagnostics.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un ensemble complet de métriques surveillées en temps réel pour évaluer la santé et les performances de vos workflows n8n.

D’un système automatisé d’alertes vous permettant d’agir rapidement en cas d’anomalie.

D’une visibilité accrue sur l’utilisation et la sécurité de votre environnement en production.

V. Monitoring de Prod

3. Alertes intelligentes

Les alertes intelligentes jouent un rôle clé dans le monitoring des workflows n8n en production. Elles permettent de détecter et de signaler automatiquement les anomalies ou incidents, garantissant une réponse rapide et proactive. En configurant des alertes adaptées, vous pouvez prévenir les interruptions de service et optimiser la gestion des workflows critiques.

Objectifs des alertes intelligentes

Détecter les anomalies

Identifier automatiquement les erreurs, ralentissements ou comportements inhabituels.

Notifier les équipes concernées

Envoyer des notifications ciblées aux responsables techniques ou métiers.

Automatiser les réponses

Déclencher des actions correctives directement depuis n8n en cas d’incident.

Améliorer la réactivité

Réduire le temps nécessaire pour résoudre les problèmes en production.

Étapes pour configurer des alertes intelligentes

1. Définir les conditions d’alerte

Identifiez les événements critiques à surveiller, tels que

Échecs répétés de workflows (taux d’erreur élevé).

Dépassement des seuils de performance (ex. latence excessive).

Saturation des ressources système (CPU, mémoire).

Configurez des seuils spécifiques pour chaque métrique clé.

2. Configurer les alertes dans n8n

Créez un workflow dédié à la gestion des alertes

Utilisez le trigger `Webhook` ou `Cron` pour surveiller régulièrement les métriques via l’API `/metrics`.

Ajoutez une logique conditionnelle pour détecter les anomalies.

Exemple de configuration

```json

{

"nodes": [

{

"parameters": {

"url": "

"responseFormat": "json"

},

"name": "Fetch Metrics",

"type": "httpRequest"

},

{

"parameters": {

"conditions": [

{

"value1": "{{ $json['latency'] }}",

"operation": ">",

"value2": 500

}

]

}, "name": "Check Latency", "type": "if" }, { "parameters": { "message": "Alert: Workflow latency exceeded threshold!", "toNumber": "+1234567890" }, "name": "Send SMS Alert", "type": "twilio" } ] }

```

3. Envoyer les notifications aux bons canaux

Intégrez vos outils de communication préférés pour notifier rapidement les équipes

Slack

Envoyez des messages dans un canal dédié.

Configurez des alertes par email pour les incidents critiques.

SMS ou appels

Utilisez Twilio ou SIGNL4 pour une notification immédiate.

Personnalisez le contenu des notifications avec des détails utiles (ex. nom du workflow, type d’erreur).

4. Automatiser les réponses aux incidents

Configurez n8n pour exécuter automatiquement des actions correctives en cas d’alerte

Redémarrer un workflow défaillant.

Désactiver temporairement un connecteur problématique.

Escalader l’incident vers une équipe spécialisée.

5. Surveiller et affiner les règles d’alerte

Analysez régulièrement l’efficacité de vos alertes (ex. taux de faux positifs).

Ajustez les seuils ou conditions pour mieux correspondre aux besoins opérationnels.

Meilleures pratiques

Priorisez les alertes critiques pour éviter une surcharge d’informations inutiles.

Testez vos workflows d’alerte dans un environnement isolé avant leur mise en production.

Documentez clairement les procédures à suivre en cas d’incident signalé par une alerte.

Outils recommandés

Twilio ou SIGNL4 pour envoyer des SMS ou appels automatisés.

Slack ou Microsoft Teams pour gérer les notifications en temps réel.

Grafana avec Prometheus pour configurer des règles d’alerte basées sur vos métriques.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un système d’alertes intelligentes capable de détecter et signaler automatiquement tout incident dans vos workflows n8n.

D’une méthode efficace pour notifier rapidement les équipes concernées et automatiser certaines réponses.

D’un processus optimisé garantissant une réactivité accrue face aux anomalies en production.

VI. Maintenance Évolutive

1. Procédures de rollback

Les procédures de rollback (retour en arrière) sont essentielles pour garantir la stabilité des workflows n8n en production. En cas de problème suite à une mise à jour ou un déploiement, elles permettent de revenir rapidement à une version précédente stable, minimisant ainsi les interruptions et les impacts négatifs sur les opérations.

Objectifs des procédures de rollback

Réduire les interruptions

Restaurer rapidement un état fonctionnel en cas d’anomalie.

Préserver la stabilité

Éviter les effets secondaires ou régressions causés par des modifications non validées.

Faciliter la gestion des incidents

Simplifier le processus de résolution en cas d’échec d’un déploiement.

Étapes pour mettre en place un rollback efficace

1. Versionnement des workflows et configurations

Utilisez un système de versionnement (ex. Git) pour conserver l’historique des modifications apportées aux workflows et configurations.

Assurez-vous que chaque version est clairement identifiée (tags, commits descriptifs).

2. Automatisation du rollback

Intégrez le processus de rollback dans votre pipeline CI/CD

Exemple avec GitHub Actions

```yaml

name: Rollback Workflow

on:

workflow_dispatch:

jobs:

rollback:

runs-on: ubuntu-latest

steps:

name: Checkout code

uses: actions/checkout@v2

name: Deploy previous version

run: git checkout && ./deploy.sh prod

```

Configurez n8n pour restaurer automatiquement les workflows précédents via l’API ou l’importation JSON.

3. Sauvegarde avant chaque déploiement

Avant chaque mise à jour, effectuez une sauvegarde complète des workflows, configurations et bases de données.

Stockez ces sauvegardes dans un emplacement sécurisé (ex. AWS S3, Google Cloud Storage).

4. Tests réguliers des procédures de rollback

Simulez des scénarios d’échec dans un environnement TEST pour valider l’efficacité du processus.

Documentez les étapes nécessaires pour exécuter un rollback manuel ou automatisé.

5. Communication en cas de rollback

Informez rapidement les équipes concernées lorsque le rollback est déclenché.

Fournissez un rapport détaillé expliquant la cause du problème et les actions entreprises.

Meilleures pratiques

Préparez toujours une version stable prête à être restaurée avant tout déploiement.

Limitez les modifications simultanées pour réduire la complexité du rollback.

Documentez clairement le processus afin que toute l’équipe puisse l’exécuter en cas d’urgence.

Outils recommandés

Git pour le versionnement et la gestion des modifications.

Plateformes CI/CD comme GitHub Actions ou GitLab CI/CD pour automatiser les rollbacks.

Services cloud (AWS, Azure) pour stocker et restaurer les sauvegardes.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un processus clair et automatisé permettant de restaurer rapidement une version stable en cas d’échec.

D’une documentation détaillée sur les procédures de rollback accessible à toute l’équipe.

D’une architecture robuste minimisant les impacts des incidents liés aux déploiements.

VI. Maintenance Évolutive

2. Gestion des dépendances

La gestion des dépendances est une étape cruciale pour garantir la stabilité et la sécurité des workflows n8n en production. Les dépendances incluent les bibliothèques, modules et outils tiers utilisés par n8n ou intégrés dans vos workflows. Une mauvaise gestion peut entraîner des problèmes de compatibilité, des vulnérabilités ou des interruptions de service.

Objectifs de la gestion des dépendances

Assurer la compatibilité

Maintenir un environnement cohérent entre les versions de n8n et les outils associés.

Prévenir les vulnérabilités

Identifier et corriger rapidement les failles de sécurité dans les dépendances.

Faciliter les mises à jour

Automatiser et simplifier le processus de mise à jour pour éviter les erreurs manuelles.

Réduire les risques d’interruption

Tester et valider les nouvelles versions avant leur déploiement en production.

Étapes pour une gestion efficace des dépendances

1. Lister et documenter les dépendances

Identifiez toutes les dépendances utilisées par n8n, y compris

Les bibliothèques Node.js (ex. `@n8n/nodes-base`).

Les connecteurs API tiers (ex. Google Sheets, Slack).

Les services externes comme Redis ou PostgreSQL.

Documentez leurs versions actuelles et leurs configurations spécifiques.

2. Utiliser un gestionnaire de paquets fiable

Utilisez `npm` ou `yarn` pour gérer les bibliothèques Node.js utilisées par n8n.

Exemple pour vérifier et mettre à jour les dépendances

```bash

npm outdated

npm update

```

3. Automatiser la surveillance des vulnérabilités

Intégrez un outil d’analyse de sécurité pour détecter les failles dans vos dépendances

Snyk

Analyse en temps réel des vulnérabilités.

npm audit

Vérification rapide des bibliothèques Node.js.

```bash

npm audit

```

Configurez des alertes pour être informé immédiatement en cas de problème critique.

4. Mettre en place une stratégie de mise à jour

Adoptez une approche progressive pour mettre à jour vos dépendances

Testez d’abord les nouvelles versions dans un environnement TEST.

Validez leur compatibilité avec vos workflows existants avant de passer en production.

Utilisez un fichier `package-lock.json` ou `yarn.lock` pour verrouiller les versions approuvées.

5. Isoler l’environnement d’exécution

Déployez n8n dans un conteneur Docker pour garantir un environnement stable et reproductible.

Exemple avec un `Dockerfile` personnalisable pour inclure uniquement les dépendances nécessaires

```dockerfile

FROM n8nio/n8n:latest

# Installer des bibliothèques supplémentaires si nécessaire

RUN npm install --no-save

```

6. Planifier des revues régulières

Effectuez une revue trimestrielle ou semestrielle des dépendances pour identifier celles qui sont obsolètes ou inutilisées.

Supprimez les modules non utilisés pour réduire la surface d’attaque.

Meilleures pratiques

Limitez l’ajout de nouvelles dépendances aux besoins strictement nécessaires.

Préférez toujours les versions stables et supportées des bibliothèques.

Documentez clairement tout changement apporté aux dépendances pour faciliter leur suivi.

Outils recommandés

npm audit, Snyk, ou Dependabot pour surveiller et gérer les vulnérabilités.

Docker pour isoler l’environnement d’exécution et simplifier la gestion des versions.

Plateformes CI/CD (GitHub Actions, GitLab CI) pour automatiser le test et le déploiement des mises à jour.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un inventaire clair et documenté de toutes vos dépendances.

D’un processus automatisé pour surveiller, tester et mettre à jour vos bibliothèques en toute sécurité.

D’une infrastructure stable et sécurisée, réduisant le risque d’interruptions liées aux incompatibilités ou vulnérabilités.

VI. Maintenance Évolutive

3. Mises à jour zero-downtime

Les mises à jour zero-downtime (sans interruption) sont une stratégie essentielle pour garantir la continuité du service lors des déploiements en production. Cette approche permet de mettre à jour n8n et ses workflows sans perturber les utilisateurs ni interrompre les processus critiques.

Objectifs des mises à jour zero-downtime

Assurer la continuité du service

Éviter toute interruption perceptible par les utilisateurs.

Minimiser les risques

Tester les nouvelles versions avant leur mise en production complète.

Simplifier les rollbacks

Permettre un retour rapide à une version précédente en cas de problème.

Optimiser la gestion des ressources

Réduire la charge sur l’infrastructure pendant les mises à jour.

Étapes pour mettre en œuvre des mises à jour zero-downtime avec n8n

1. Utiliser une architecture Blue/Green

Déployez la nouvelle version dans un environnement Green, tout en conservant l’environnement Blue actif pour le trafic utilisateur.

Une fois validée, basculez progressivement le trafic vers l’environnement Green.

En cas de problème, revenez rapidement à Blue.

2. Mettre en place un système de réplication logique

Configurez une réplication logique entre deux bases de données PostgreSQL (source et destination) pour garantir que les données restent synchronisées pendant la mise à jour.

Cela permet à l’ancienne et la nouvelle version d’n8n de fonctionner simultanément avec une base commune.

3. Automatiser le déploiement avec Docker et un load balancer

Utilisez Docker pour gérer les conteneurs n8n et effectuer des mises à jour rapides.

Configurez un load balancer (ex. AWS Elastic Load Balancer) pour répartir le trafic entre plusieurs instances d’n8n pendant la mise à jour.

4. Tester en production avec des techniques canary ou A/B

Dirigez une petite portion du trafic utilisateur vers la nouvelle version (canary testing).

Analysez les performances et comportements avant de basculer tout le trafic.

5. Configurer un monitoring actif pendant les mises à jour

Surveillez les métriques clés (latence, taux d’erreur, utilisation CPU/mémoire) pour détecter rapidement toute anomalie.

Utilisez des outils comme Grafana ou Datadog pour visualiser l’état du système en temps réel.

6. Planifier des sauvegardes avant chaque mise à jour

Effectuez une sauvegarde complète des workflows, configurations et bases de données avant le déploiement.

Stockez ces sauvegardes dans un emplacement sécurisé (ex. AWS S3).

7. Automatiser le rollback en cas d’échec

Configurez votre pipeline CI/CD pour permettre un retour rapide à la dernière version stable.

Exemple avec GitHub Actions

```yaml

name: Zero Downtime Rollback

on:

workflow_dispatch:

jobs:

rollback:

runs-on: ubuntu-latest

steps:

name: Checkout previous version

run: git checkout

name: Redeploy previous version

run: ./deploy.sh prod

```

Meilleures pratiques

Communiquez clairement avec les équipes techniques et métiers avant chaque mise à jour.

Effectuez des tests approfondis dans un environnement TEST avant de passer en production.

Documentez toutes les étapes nécessaires pour garantir une mise à jour fluide.

Outils recommandés

Docker et Kubernetes pour gérer les conteneurs et orchestrer les déploiements.

AWS Elastic Beanstalk ou Azure App Services pour simplifier les mises à jour zero-downtime.

Grafana ou Datadog pour surveiller l’état du système pendant le déploiement.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’un processus robuste permettant de mettre à jour n8n sans interruption perceptible par les utilisateurs.

D’une architecture prête à gérer efficacement les mises à jour tout en minimisant les risques.

D’un mécanisme automatisé pour effectuer un rollback rapide en cas d’échec.

VII. Cas Spéciaux

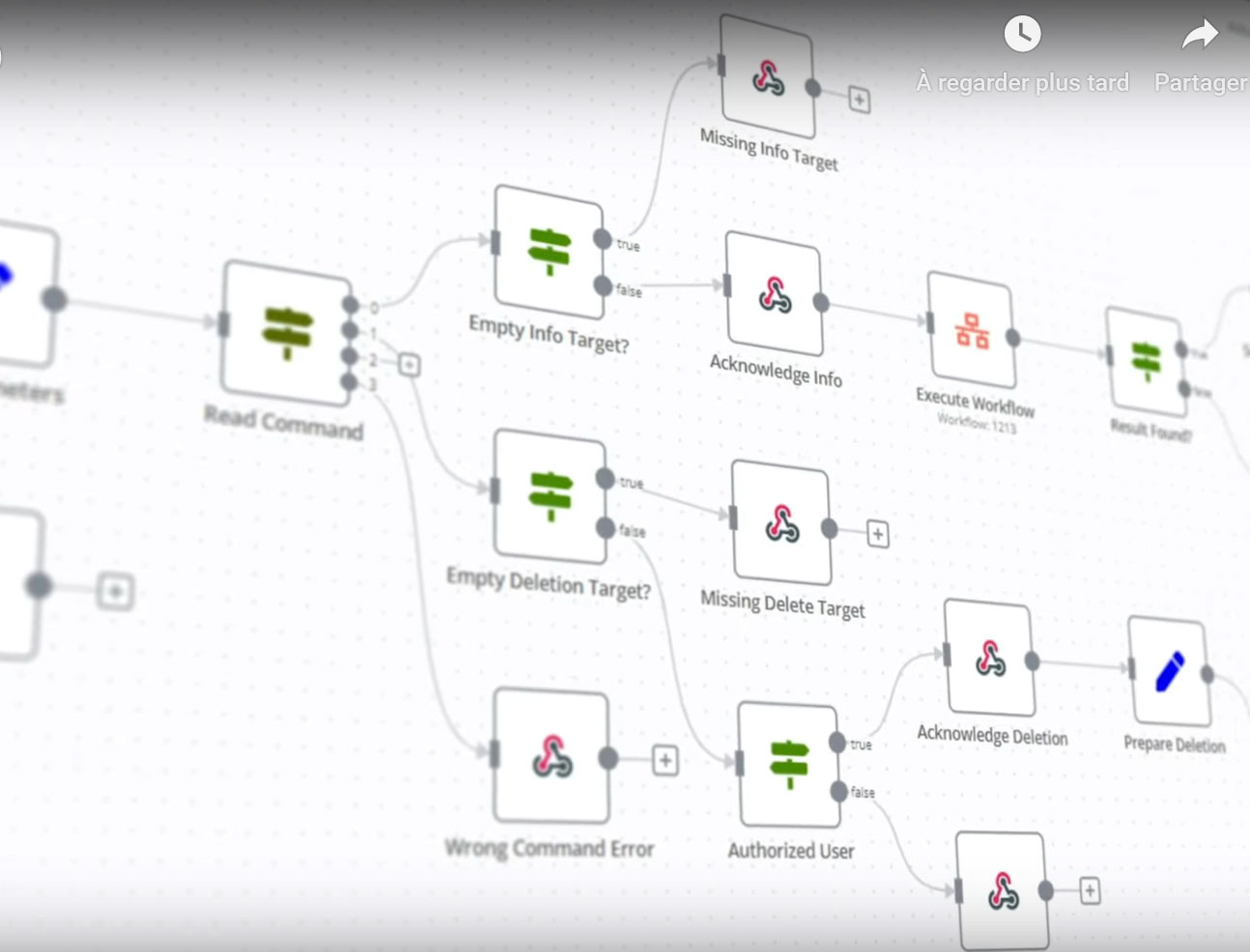

1. Workflows critiques

Les workflows critiques sont des processus automatisés qui ont un impact direct sur les opérations essentielles de l’entreprise. Leur gestion nécessite une attention particulière pour garantir leur fiabilité, leur sécurité et leur disponibilité en toutes circonstances. Ces workflows peuvent inclure des tâches comme la gestion des paiements, l’envoi de notifications importantes ou le traitement de données sensibles.

Objectifs pour les workflows critiques

Assurer une haute disponibilité

Éviter toute interruption qui pourrait impacter les opérations clés.

Renforcer la sécurité

Protéger les données sensibles manipulées par ces workflows.

Minimiser les risques

Prévoir des mécanismes de reprise en cas d’échec.

Optimiser les performances

Garantir des temps d’exécution rapides et stables.

Étapes pour gérer efficacement les workflows critiques

1. Identification des workflows critiques

Analysez tous les workflows existants pour identifier ceux qui ont un impact majeur sur les opérations ou la satisfaction client.

Classez-les selon leur criticité (ex. faible, moyenne, élevée) en fonction de leur rôle stratégique.

2. Isoler les workflows critiques

Hébergez ces workflows sur une infrastructure dédiée ou prioritaire pour éviter qu’ils ne soient affectés par d’autres processus.

Configurez des ressources spécifiques (CPU, mémoire) pour garantir leur performance.

3. Renforcer la sécurité

Activez le chiffrement des données sensibles au repos et en transit.

Implémentez une double authentification (2FA) pour accéder aux configurations de ces workflows.

Limitez l’accès aux utilisateurs autorisés uniquement via un contrôle strict des permissions.

4. Mettre en place des mécanismes de reprise

Configurez une logique de retry dans n8n pour réexécuter automatiquement un workflow en cas d’échec.

Planifiez des sauvegardes régulières des données générées ou utilisées par ces workflows.

Implémentez un système de failover pour basculer vers une instance secondaire en cas de panne.

5. Surveiller activement les workflows critiques

Configurez des alertes spécifiques pour détecter rapidement tout problème (ex. latence excessive, taux d’erreur élevé).

Utilisez un outil de monitoring comme Grafana ou Datadog pour suivre leurs performances en temps réel.

6. Tester régulièrement leur résilience

Simulez des scénarios d’échec dans un environnement TEST pour valider leur capacité à gérer les interruptions.

Effectuez des audits réguliers pour vérifier leur conformité et leur efficacité.

Meilleures pratiques

Documentez clairement chaque workflow critique, y compris ses dépendances et ses configurations.

Préparez une procédure détaillée pour gérer les incidents liés à ces workflows.

Effectuez une revue trimestrielle pour identifier d’éventuels points faibles ou améliorations possibles.

Outils recommandés

Outils de monitoring comme Prometheus avec Grafana pour surveiller les performances.

Plateformes cloud avec haute disponibilité (ex. AWS RDS, Azure) pour héberger les bases de données associées.

Gestionnaires secrets comme HashiCorp Vault ou AWS Secrets Manager pour sécuriser les accès et configurations.

Résultat attendu

À l’issue de cette étape, vous disposerez

D’une gestion optimisée et sécurisée de vos workflows critiques, garantissant leur fiabilité et leur disponibilité.

D’un système robuste capable de prévenir et gérer efficacement les incidents liés à ces processus essentiels.

D’une documentation complète facilitant leur maintenance et leur évolution.

VII. Cas Spéciaux

2. Intégrations IA sécurisées

Les intégrations IA sécurisées sont essentielles pour garantir que les workflows automatisés utilisant des modèles d’intelligence artificielle (IA) respectent les normes de sécurité et de confidentialité. n8n offre des connecteurs pour intégrer des modèles IA comme OpenAI, Claude, ou Llama, permettant de créer des automatisations intelligentes tout en protégeant les données sensibles.

Objectifs des intégrations IA sécurisées

Protéger les données sensibles

Assurer que les informations traitées par les modèles IA ne sont pas exposées.

Garantir la conformité réglementaire

Respecter les exigences légales en matière de protection des données (ex. RGPD).

Optimiser la sécurité des API